現在、性能の向上した生成系AIの登場により、生徒が内容を理解していなくとも授業で出された課題をこなすことが出来るようになってしまった.これは、生成系AIが課題の解答や回答を提供することで、生徒たちが単に課題をこなすだけの作業に集中し、問題の本質や背景を理解する機会を逸してしまう可能性がある.生徒が実際に問題を理解する必要がなくなってしまうような状況は、授業課題が本来持つべき学修成果が損なわれてしまっていると考えられる.したがって、教育者や学術機関は、生成系AIが生徒の学習に与える影響を慎重に考慮し、生徒が深い理解と問題解決能力を養うための適切な教育環境を提供する必要がある.具体的には、生成系AIの得意な領域と苦手な領域を把握し、それを活かした授業課題を設計することが重要であると考える.そのため本研究は、生成系AIの使用を禁止にするという選択をしなくとも、授業課題を生徒に解いてもらうことが可能になり、生成系AIの使用を禁止にするという選択が減ることへの効果が期待できる.

深層学習(ディープラーニング)とは、人間の神経細胞の仕組みを再現したニューラルネットワークを用いた機械学習の手法の1つであり、多層構造のニューラルネットワークを用いることが特徴である.現在では画像認識や音声認識、翻訳などさまざまな分野で大きな成果を生み出している.深層学習の仕組みを使って画像認識や音声認識などを行うには、まずラベル付けされたデータ(教師データ)を用いて学習させる必要がある.たとえば手書きの数字をAIによって認識させたいといった場合、手書きした数字の画像と、その画像に書かれた正しい数字を示したラベルをセットにした教師データを用意し、多層構造のニューラルネットワークに入力する.この教師データを使って自動的に学習を行い、手書き数字を認識できるようになるという仕組みである.ただし、認識精度を高めるためには膨大な量の学習データが必要であり、従来はそれを用意することが困難だった.しかし現在はインターネットの普及などによって膨大なデータを用意することが可能になっている.また学習には膨大な計算を行う必要があるが、これもコンピューターの進化によって短時間で学習できる環境を整えられるようになった.このように環境が整備されたことも、深層学習が進化した大きな要因である.

「ニューラルネットワーク(Neural Network:NN)」とは、人間の脳内にある神経細胞(ニューロン)とそのつながり、つまり神経回路網を人工ニューロンという数式的なモデルで表現したものである.ニューラルネットワークは、人間の脳の働きを模した方法でデータを処理するようにコンピュータに教える人工知能の一手法である.これは、深層学習と呼ばれる一種の機械学習プロセスであり、人間の脳に似た層状構造で相互接続されたノードやニューロンを使用する.そこから適応型システムが作成され、コンピューターはそれを使用して過ちから学び、継続的に改善することができる.

機械学習とは、データを分析する方法の1つで、データから、「機械」(コンピューター)が自動で「学習」し、データの背景にあるルールやパターンを発見する方法.近年では、学習した成果に基づいて「予測・判断」することが重視されるようになった.

物事の状態・性質や将来を、部分的・間接的に知り得た事柄や数値から、おしはかること.

大規模言語モデル(Large Language Models、LLM)とは、非常に巨大なデータセットとディープラーニング技術を用いて構築された言語モデルである.ここでいう「大規模」とは、従来の自然言語モデルと比べ、後述する3つの要素「計算量」「データ量」「パラメータ数」を大幅に増やして構築されていることに由来します.大規模言語モデルは、人間に近い流暢な会話が可能であり、自然言語を用いたさまざまな処理を高精度で行える.

Transformerとは、2017年に発表された"Attention Is All You Need"という自然言語処理に関する論文の中で初めて登場した深層学習モデルである.それまで主流だったCNN、RNNを用いたエンコーダ・デコーダモデルとは違い、エンコーダとデコーダをAttentionというモデルのみで結んだネットワークアーキテクチャである.

畳み込みニューラル ネットワーク (CNN または ConvNet) とは、データから直接学習するディープラーニングのためのネットワーク アーキテクチャです.CNN は、オブジェクト、クラス、カテゴリを認識するために画像の中からパターンを検出するのに特に有効です.音声、時系列、信号データを分類する際にも非常に有効な手法です.

リカレントニューラルネットワーク (RNN) は、時系列データまたはシーケンシャルデータを用いた予測を行うディープラーニングのネットワーク アーキテクチャです.RNNは、さまざまな長さのシーケンシャルデータを使用して、自然信号の分類、言語処理、動画解析などの問題を解く場合に特に効果的である.

シーケンシャルデータとは、時間や順序に基づいて並んでいるデータのことである.具体的には、時間順に並んでいる時系列データや、順序が重要な系列データなどがこれに該当する.例えば、テキスト文書、音声、動画、センサーデータ、DNA配列などがシーケンシャルデータの例として挙げられる.シーケンシャルデータは、その特性から様々な分野で利用されている.例えば、自然言語処理では文章の解析や機械翻訳、音声認識では音声データの解析、金融データでは時系列データの分析などに応用されている.シーケンシャルデータを解析する際には、その時間的なパターンや順序の関係性を考慮する必要がある.

オートエンコーダ(自己符号化器, autoencoder)とは、ニューラルネットワークを利用した教師なし機械学習の手法の一つです.次元削減や特徴抽出を目的に登場したが、近年では生成モデルとしても用いられている.オートエンコーダの学習は、入力データと一致するデータを出力することを目的とする教師なし学習である(後述のように教師あり学習とすることもできる).オートエンコーダのネットワークは、入力したデータの次元数をいったん下げ、再び戻して出力するという構造になっている.このため、入力から出力への単なるコピーは不可能でである.オートエンコーダの学習過程では、入出力が一致するように各エッジの重みを調整していく.この学習を通して、データの中から復元のために必要となる重要な情報だけを抽出し、それらから効率的に元のデータを生成するネットワークが形成される.こうしてオートエンコーダの前半部分は次元削減、特徴抽出の機能を獲得し、後半部分は低次元の情報をソースとするデータ生成機能を獲得する.前半部分をエンコーダ、後半部分をデコーダと呼ぶ.学習後、この2つのネットワークは別々に使うことができる.すなわち、エンコーダは特徴抽出器、デコーダは生成器として独立に用いることができる.

深層学習(ディープラーニング)による生成モデルの一つで、教師データを利用せず学習データの特徴を捉えた「学習データに似たデータ」を生成する.つまり、元の学習用の画像データの特徴を学習することで、似たような画像を生成できる生成モデルである.

GANとは「敵対的生成ネットワーク」(Genera tive Adversarial Networks)である.GANは生成モデルの一種であり、データから特徴を学習することで、実在しないデータを生成したり、存在するデータの特徴に沿って変換できる.GANは、正解データを与えることなく特徴を学習する「教師なし学習」の一手法として注目されている.

テキストコーパスは、自然言語処理(NLP)や機械学習の研究において使用される大規模なテキストデータの集合体である.これらのデータセットには、様々なソースから収集された文章が含まれます.例えば、ウェブページ、ニュース記事、書籍、雑誌、ユーザー生成コンテンツなどがある.テキストコーパスは、言語モデルのトレーニングやテスト、または言語処理タスクの評価に使用される.言語モデルをトレーニングする際には、大規模なテキストコーパスを用いてモデルが言語のパターンや文脈を学習することが求められる.また、特定のタスクにおいてモデルの性能を評価する際にも、テキストコーパスが利用される.テキストコーパスのサイズや内容は、研究目的やタスクに応じて異なる.一般的には、より大規模で多様なデータセットが、より汎用性の高い言語モデルのトレーニングに貢献する.

データセットは、特定の目的のために収集された、構造化されたデータの集合体である.これらのデータは、通常、共通のテーマや属性を持つ一連の観測やサンプルから成り立つ.データセットには、さまざまな形式や種類のデータが含まれることがあり、一般的には表形式(テーブル)、画像、音声、テキストなどが該当する.データセットは、機械学習やデータ分析の研究や開発において重要な役割を果たす.これらの分野では、データセットを使用してモデルをトレーニングしたり、モデルの性能を評価することに利用する.例えば、分類や回帰などの予測モデルを構築する際には、ラベル付きのデータセットが必要である.画像認識や音声認識のモデルを構築する際には、画像や音声データのデータセットが必要となる.データセットは、公開されたものや自分で収集したもの、または第三者から購入したものなど、さまざまな方法で入手することが可能である.機械学習の研究者やデータサイエンティストは、適切なデータセットを選択し、データの前処理や特徴エンジニアリングなどの作業を行って、モデルのトレーニングや評価を行う.

事前学習済み言語モデルは、大規模なテキストコーパスを用いて事前にトレーニングされた自然言語処理(NLP)モデルのことを指す.これらのモデルは、様々な自然言語理解タスクにおいて高度な性能を発揮するために設計されている.事前学習済み言語モデルのトレーニングプロセスでは、巨大なテキストコーパス(例えば、ウェブページ、ニュース記事、書籍、ソーシャルメディアの投稿など)を用いて、モデルが言語のパターンや構造を理解するように学習を行う.この学習は、大量のデータと計算リソースが必要であり、通常は複数のGPUやTPU(Tensor Processing Unit)を使用して行われる.

そして、事前学習済み言語モデルは一般的に大規模なトランスフォーマーアーキテクチャに基づいており、例えばBERT(Bidirectional Encoder Representations from Transformers)、GPT(Generative Pre-trained Transformer)、XLNet、RoBERTaなどがある.これらのモデルは、言語の文脈を理解し、単語や文章の意味を表現するための多層のニューラルネットワークを含んでいる.

更に、事前学習済み言語モデルはファインチューニングと呼ばれるプロセスを通じて特定のタスクに適用される.ファインチューニングでは、特定のデータセットやタスクに合わせてモデルが微調整され、例えば感情分析、質問応答、文書要約、翻訳などのさまざまな自然言語処理タスクに適用される.これにより、一般的な言語理解能力を持つモデルをさまざまな特定のタスクに適応させることができる.

AIとは、「Artificial Intelligence(アーティフィシャル・インテリジェンス)」の略称であり、日本語では「人工知能」を意味する.AIは一般的に、人間の言葉の理解や認識、推論などの知的行動をコンピュータに行わせる技術を指す.人工知能の概念は1950年頃から存在していたが、「AI」という言葉を用いたのはダートマス大学の計算機科学者、ジョン・マッカーシー教授である.1956年に同大学で行われた研究会において、初めて公に「AI」という言葉が使用されたと言われている.

生成系AI(または生成AI)とは、「Generative AI」とも呼ばれ、さまざまなコンテンツを生成できるAIのことである.従来のAIが決められた行為の自動化が目的であるのに対し、生成系AIはデータのパターンや関係を学習し、新しいコンテンツを生成することを目的としている.従来のAIとの違いとしては、決められた行為の自動化が目的であったが、生成系AIは新しい形で創造が行えていると考えられている.

テキスト生成AIは、自然言語処理(NLP)の一分野であり、統計 的なモデルを用いて大規模なテキストデータセットを学習し、与 えられた文脈に基づいて次の単語や文を予測し、「それらしい応 答」を生成する.この技術の背後には、Transformerアーキテク チャなどのニューラルネットワークが利用されている.

Transformerは、2017年にGoogleによって提案されたニューラルネット ワークアーキテクチャであり、Attention Mechanism(注意機構)を用 いて文の間の長距離の依存関係をキャプチャする.このAttention Mechanism(注意機構)は、自然言語処理(NLP)や機械翻訳などのタス クで使用されるニューラルネットワークの一部であり、特に長い文や文 書を処理する際に有用である.このメカニズムは、入力された文の各単 語やトークンが処理される際に、他の単語やトークンに注意を払うこと を可能にする.具体的には、Attention Mechanismは、入力文の各単語 に重みを割り当てる.これにより、入力の異なる部分に異なる程度の重 要性を付与し、重要な情報に重点を置くことができる.例えば、翻訳タ スクでは、文の意味を理解する際に、翻訳される文の特定の単語に重点 を置く必要がある.この注意機構は、Transformerアーキテクチャなど のモデルに広く使用されており、特に長い文を処理する場合に優れた性 能を発揮します.Attention Mechanismによって、モデルは文脈をより 正確に理解し、より適切な応答や翻訳を生成することが可能となる.

また、テキスト生成AIにおける最新の進歩の一つは、事前学習済み言語 モデルの使用である.これは、大規模なテキストコーパスを用いて事前 に訓練されたモデルを指します.例えば、OpenAIのGPT(Generative Pre-trained Transformer)シリーズやGoogleのBERT(Bidirectional Encoder Representations from Transformers)などがあります.これ らのモデルは、膨大なデータセットを用いて文の言語構造や意味を獲得 し、ファインチューニングによって特定のタスクに適応させることがで きる.

さらに、テキスト生成AIの性能向上には、教師あり学習や教師なし学習 などの機械学習手法が活用される.教師あり学習では、正解ラベル付き のデータを用いてモデルを訓練し、教師なし学習では、ラベルが付与さ れていないデータからパターンを見つけ出すことでモデルを学習させる. これらの技術の組み合わせにより、テキスト生成AIは、与えられた文脈 や条件に基づいて高度な応答を生成することが可能となる.

本研究で注目する特徴としては、ある単語や文章の次に来る単語や文章を推測し、「統計的にそれらしい応答」を生成しているという部分に注目する.

画像生成系AIとは、主に完成形のイメージや雰囲気をテキストで与えるだけで、自動的にAIが画像を生成できるサービス・ソフトウェアの総称である.例えば、「ネコ、昼寝」という情報を与えれば、昼寝をしているネコの写真を撮影したような画像やイラストが生成される.主に画像生成AIは、入力されたテキストから学習済みのデータを基に特徴を探し、一致する特徴から画像を生成する仕組みとなっている.[12] 本研究で注目する特徴としては、「一致する特徴から画像を生成する仕組み」となっている部分に注目する.

ChatGPTは、OpenAIが開発した自然言語処理(NLP)モデルの一種であり、Transformerアーキテクチャが採用されている.Transformerは、Attention Mechanism(注意機構)を用いて文脈を理解し、複雑な言語パターンを学習することができるニューラルネットワークの一種である.ChatGPTは、大規模なテキストデータセットを用いて事前に訓練されている.この訓練プロセスでは、モデルは文脈を理解し、言語の構造や意味を獲得するために、膨大な量のテキストを通じて学習する.例えば、ウェブ上の文章や書籍、ニュース記事などのテキストが利用され、これらのデータを通じてChatGPTは言語の構造や意味を獲得する.このような事前訓練により、ChatGPTは様々な自然言語理解タスクにおいて優れた性能を発揮できるようになる.さらに、ChatGPTは転移学習を通じて、特定のタスクやドメインにおいて高度な性能を発揮できるようにファインチューニングを行う.特に対話型タスクにおいては、ChatGPTは入力されたテキストの文脈を理解し、応答文を生成する際にその文脈を適切に考慮する.これにより、自然で流暢な応答を生成することが可能となる.また、対話の流れや談話の一貫性を維持することも重視されており、モデルが会話のコンテキストを適切に把握し、一貫性のある応答を生成することが求められる.このように、ChatGPTはTransformerアーキテクチャを基盤として、大規模なテキストデータセットを用いて事前に訓練され、対話型タスクに特に適した能力を持つ自然言語処理モデルとして注目されている.

BingAIとは、Microsoftが開発したAI搭載の検索エンジンである.BingAIは、自然言語での検索やチャット、コンテンツの要約や作成など、さまざまな機能を提供している.BingAIは、GPT-4という強力なAIモデルを利用しており、高度な自然言語理解と生成能力を持つ.BingAIは、Microsoft Edgeのサイドバーに組み込まれており、ブラウザから簡単にアクセスできる.BingAIは、ChatGPTという別のAIチャットモードとは異なり、検索結果やウェブページのコンテキストに基づいて回答や要約を行うことができる.BingAIは、ユーザーの生活や仕事に役立つAIパートナーとして機能することを目的としている.

Bardは、Googleが開発した最先端の大規模言語モデル(LLM)である.2023年5月に発表され、2023年10月に一般公開された.Bardは、膨大なテキストとコードのデータセットで訓練されており、質問応答、文章生成、翻訳、要約、コード生成、質問作成、文章校正のような様々なタスクを実行することができる.Bardは、以下の技術を基盤として構築されている.Transformerモデル: Transformerモデルは、Google Researchが2017年に開発したニューラルネットワークアーキテクチャである.従来のRNNモデルと比べて、長距離依存関係を効率的に処理できるため、自然言語処理タスクにおいて高い精度を実現することを目指している.

文部科学省は初等中等教育段階における生成AIの利用に関する暫定的なガイドラインを発表した.以下はその中の一文である.「生成系AIは黎明期にあり、技術革新やサービス開発が飛躍的なスピードで進展している.こうした中、教育現場においても、様々な活用のメリットを指摘する声がある一方、子供がAIの回答を鵜呑みにするのではないか等、懸念も指摘されている.その一方で、児童生徒や教師を含め、社会に急速に普及しつつある現状もあり、一定の考え方を国として示すことが必要である.」[4]このように生成系AIは教育現場において様々な活用のメリットが指摘されているが、一方で生徒への悪影響も懸念されている.そして文部科学省から提示されているガイドラインは未だ暫定的な物であり、今後、教育者の生成系AIとの付き合いについて深く検討されるものと推測さできる.

生成系AIの性能向上は教育活動に対し大きな影響があると考えられる.良い影響としては教材作成やテスト作成、採点などの作業の補助として生成系AIの利用が出来るのではないかと考えられており、教師の負担軽減に繋がることが期待できる.他にも生徒の自学習の際、の補助ツールとしての利用なども期待されている.逆に、悪い影響も考えられる.一つ目は、生成系AIには差別的な表現や偏った情報を生成する可能性があると考えられており、生徒はその偏った情報を学習してしまう恐れがある.二つ目は、生徒が生成系AIに依存してしまう可能性があげられる.生成系AIに依存してしまうと学習者の思考力や問題解決能力が低下する可能性がある.生成系AIはあくまで学習の補助ツールとして位置づけ、適切な使い方を指導する必要がる.三つ目は、生成系AIによって生成されたコンテンツの著作権は、誰が所有するのかといった問題がある.また、生成系AIの学習物が他者の著作物を学習元にしている可能性もあり、意図せずして著作権侵害をしてしまう可能性が潜んでいる.四つ目は、教師のAIに対する知識不足があげられる.すべての教師が生成系AIについて詳しいということは無く、教師がどの様な場面で生成系AIを活用し、どのような場面で生成系AIを活用することが望ましくないというような判断は現状の課題である.文部科学省から暫定的なガイドラインは出ているものの、それだけでは十分とは言えないだろう.その為、本研究では生成系AIの得意な領域と苦手な領域を把握し、それを活かした授業課題を設計する手法を検討する.

生成系AIの進歩により、生徒が内容を理解していなくとも授業で出された課題をこなすことが出来るようになってしまったのではないかと危惧されているが、その危惧が正しいかを確認する必要があると考えた.その為今回は情報Ⅰの教科書を実際に生成系AIに解かせ実際の影響を確認した.

実際に高等学校情報Ⅰの教科書[11]を生成系AIに解かせた.利用した生成系AIはChatGPT(OpenAI)、BingAI(Microsoft)、Bard(Google)の3つであり、解かせた問題は教科書の章末問題と巻末問題である.テキストで問題文を与えられる問題が119問、画像の読み取りが必要な問題が33問である.以下に章ごとの問題数を表 1として示す.

| テキストを読む問題 | 画像を読む問題 | |

|---|---|---|

| 第1章 | 28 | 6 |

| 第2章 | 19 | 4 |

| 第3章 | 18 | 7 |

| 第4章 | 17 | 4 |

| 巻末問題 | 37 | 12 |

問題の内容ごとに正答率が変わることが考えられるため、以下に教科書の章ごとの内容を表 2として示す.

| 第1章 | 情報社会の問題解決 |

| 第2章 | コミュニケーションと情報デザイン |

| 第3章 | コンピュータとプログラミング |

| 第4章 | 情報通信ネットワークとデータの活用 |

| 巻末問題 | 教科書全体を通した総合的な問題 |

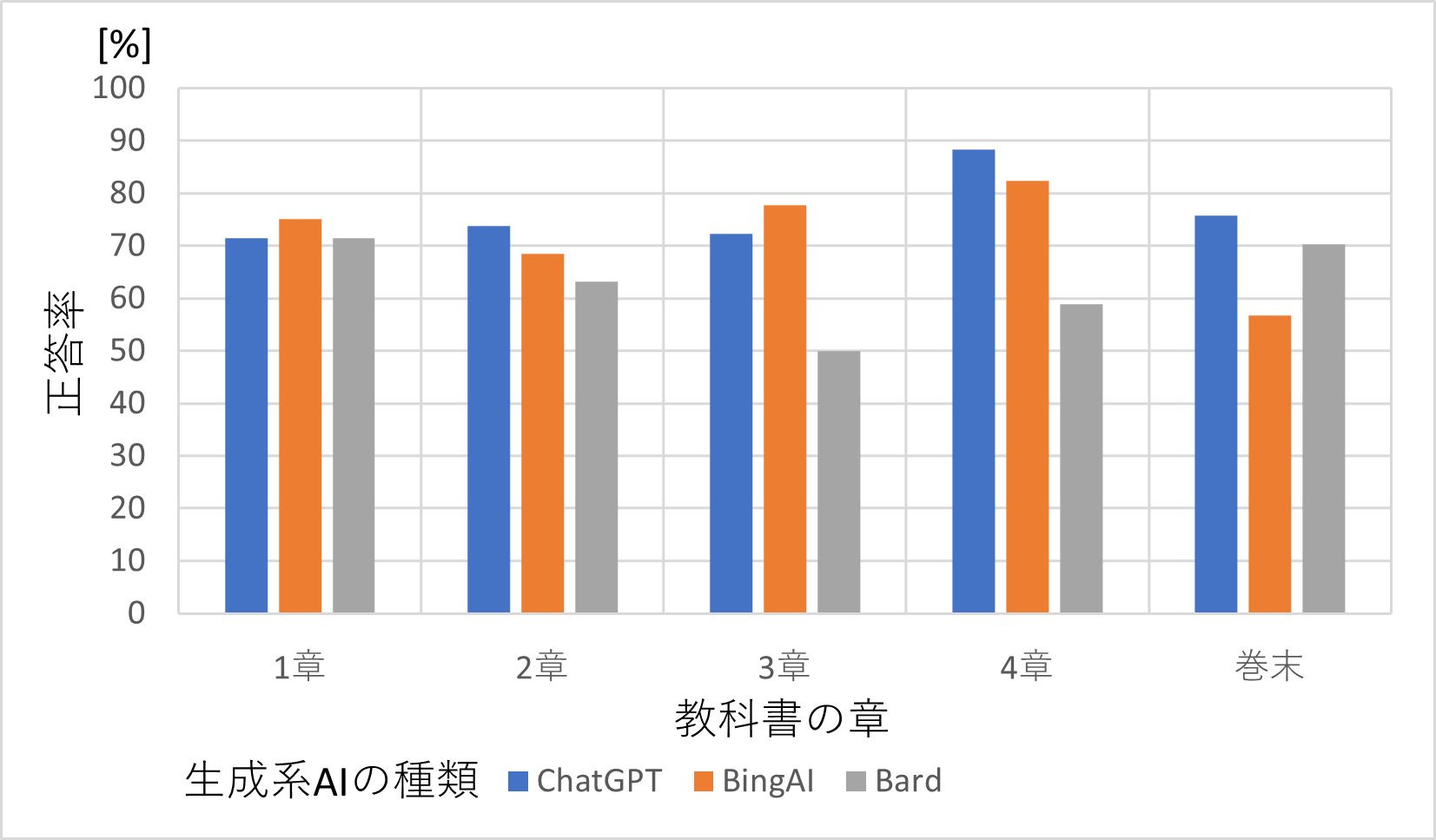

教科書のテキストを読む問題を生成系AIに解かせた際の正答率を、章、生成系AIの種類に分けてまとめたものを以下に図 1として示す.

図1を見ると、どの生成系AIも90%以上の正答率はなく、逆に50%以下の正答率もない.そして、表 2 教科書の章ごとの内容の教科書の章ごとの内容と合わせてみると、生成系AIごとに問題内容の得意不得意があることが読み取れる.特に3章と4章、巻末問題は生成系AIごとの正答率の差が大きい.

テキストを読み込む問題で生成系AIの誤りが多かった問題は、生成系AIが苦手としている問題形式である可能性が高いと考えられる.その為、生成系AIが誤った内容を返したいくつかの問題を詳しく見ていく.

著作物の保護と活用について説明した(1)~(5)の文章のうち,下線部が正しいものには〇で答え,誤っているものは訂正するといった内容の問題である.以下に第1章[2]の生成系AIの回答を表 3として示す.教科書の回答と比べ誤りであると判断した内容には黄色でセルを強調表示している.

| ChatGPT | BingAI | Bard | 教科書の解答 | ||

|---|---|---|---|---|---|

| [2] | 1 | × | × | × | 〇 |

| 2 | 〇 | 〇 | 〇 | 著作者人格権(同一性保持権) | |

| 3 | × | × | × | 著作権侵害である | |

| 4 | × | × | × | 私的使用とは言えない | |

| 5 | × | × | × | ○ | |

この問題はテキスト形式で生成系AIに取り込んだ.その為、下線部は消えてしまう.その為生成系AIには「下線部が正しいもの」が認識できなかった可能性がある.しかし、この問題は著作物の保護と活用について説明した文章の正誤判定である.その為、「下線部」が分からずとも問題の正誤は判別できると考える.しかし、生成系AIはすべてにおいて誤った回答を示した.次に誤っているものは訂正するように問題文は書かれているが、生成系AIは「×」と示しただけで訂正を行わなかった.これは問題文の内容を正しく理解できていないことを示す. 生成系AIは学習元データに無い物は正確に答えられないという性質もあるため、このような正しいかどうかを判別するのは苦手なのではないかとも考えられる.

以下に第1章[4]の問題文を示す.この問題は各選択肢の文章を読み、パスワードのパターンがより多い方を答える問題である.以下に第1章[4]の生成系AIの回答を表 4として示す.教科書の回答と比べ誤りであると判断した内容には黄色でセルを強調表示している.

| ChatGPT | BingAI | Bard | 教科書の解答 | ||

|---|---|---|---|---|---|

| [4] | 1 | イ | ア | ア | ア |

| 2 | イ | イ | ア | イ | |

この問題は文字列のパターン数を考え、よりパターンが多い方を答える問題である.一般的に大きな数の計算はコンピュータの方が得意とされているが、今回生成系AIは誤った回答を示した.これは問題文を計算式に起こしなおして問題を解いていないと予想できる.

この問題は問題文を読み、データ量を求める問題である.以下に第2章[6]の生成系AIの回答を表 5として示す.教科書の回答と比べ誤りであると判断した内容には黄色でセルを強調表示している.

| ChatGPT | BingAI | Bard | 教科書の解答 | ||

|---|---|---|---|---|---|

| [6] | 1 | 16,777,216 | 16777216 | 16,777,216通り | 16,777,216 |

| 2 | 5.95MB | 5.94MB | 6.06 MB | 5.93MB | |

| 3 | 143.32MB | 5.94MB | 173.87 MB | 142.38MB | |

| 4 | 82.94MB | 20.63MB | 13.51 MB | 82.39MB | |

この問題はデータ量を求める問題である.一般的に大きな数の計算はコンピュータの方が得意とされているが、今回生成系AIは誤った回答を示した.これは問題文を計算式に起こしなおして問題を解いていないと予想できる.理由としては(1)の「RGB各色256階調では,何通りの色を扱えるか答えなさい.」という問題には正解していることから推測できる.この問題はRGBの各色が256段階ある事から計算しなくとも学習元データに16777216通りあるという内容が学習されている可能性が高い.逆にその他の問題は、学習元に無いデータである可能性の高い細かな指定のある問題である.さらに、どの段階で四捨五入をするかの判断も重要であり、丸め誤差が発生しているとも考えられる.教科書のこの問題は人間にとってはある程度解きやすいような数字が選ばれているが、それを生成系AIが理解できている可能性は低いと考える.

この問題は問題文を読み、( )に適切な数字や記号を入れる問題である.以下に第3章[2]の生成系AIの回答を表 6として示す.教科書の回答と比べ誤りであると判断した内容には黄色でセルを強調表示している.

| ChatGPT | BingAI | Bard | 教科書の解答 | ||

|---|---|---|---|---|---|

| [2] | 1 | 1101 | 1101 | 11001 | 1101 |

| 2 | 10011 | 10011 | 10111 | 10011 | |

| 3 | 0 | 10 | 10000 | 0 | |

| 4 | 10010 | 10110 | 11010 | 10110 | |

| 5 | 110 | 110 | 110 | 110 | |

| 6 | 11100 | 11100 | 10010 | 11100 | |

| 7 | -12 | -28 | -2 | -4 | |

| 8 | 101.11 | 101.11 | 101.11 | 101.11 | |

| 9 | 1.0111x2^2 | 1.0111*2^2 | 1.0111*2^2 | ||

この問題は( )に適切な数字や記号を入れる問題である.生成系AIの回答を見るとBardがこの問題を苦手としていることがわかる.ChatGPTとBingAIを見るとChatGPTは③と⑦を誤っており、BingAIは④と⑦を誤っている.逆にすべての生成系AIは⑤を正解している.③は「①と②を加算した結果を桁数5ビットであらわす」という問題であり、①と②の結果を代入しなければ解けない問題である.⑦は④と⑤の結果を代入して求めた⑥を代入して解く問題である.

この問題は各選択肢の文章を読み、文章で回答する問題である.以下に第3章[4]の生成系AIの回答を表 7として示す.教科書の回答と比べ誤りであると判断した内容には黄色でセルを強調表示している.

| ChatGPT | BingAI | Bard | 教科書の解答 | ||

|---|---|---|---|---|---|

| [4] | 1 | モデル化の目的は、与えられた条件(横18cm、縦27cmの台)の中で、直径6cmの丸い小皿をできるだけ多く並べることができるかを検証することです. | 台の上に丸い小皿をできるだけ多く並べるための最適な配置を探求すること. | 台:横18cm、縦27cmの長方形 丸い小皿:直径6cmの円形 | より多くの小皿を台の上に置く並べ方を見つけること. |

| 2 | 要素: 台、丸い小皿関係: 丸い小皿を台に並べる際、小皿同士が重ならないように配置する.また、小皿の直径や配置の仕方によって、できるだけ多くの小皿を配置する. | ・台の寸法(横18cm × 縦27cm)・小皿の直径(6cm) | 要素台:・横18cm、縦27cmの長方形 ・丸い小皿:直径6cmの円形 関係・小皿は台からはみ出さない・小皿は互いに重ならない | 台の横の長さと縦の長さ,小皿の底面の形状と大きさ. | |

| 3 | 台の形状やサイズを確認し、小皿同士が重ならないように配置するための基準を設けることが重要です.また、小皿の直径や配置パターンを調整するために、シミュレーションのための紙モデルやソフトウェアが必要です. | 丸い小皿を円形に切った紙(直径2cm)以外に、定規やペンなどの道具を用意する. | ・円形に切った紙(直径2cm):小皿のモデル・台のモデル(横18cm、縦27cmの長方形):紙や段ボールなど・鉛筆や定規・シミュレーションを行うためのスペース | 横6cm×縦9cmの長方形を作図した紙(横6cm×縦9cmの長方形の紙). | |

| 4 | シミュレーションの具体的な結果は、小皿の配置パターンや条件に依存します.模型やグラフィカルなシミュレーションを通じて、最大何枚配置できるかを確認する必要があります. | 台の寸法を考慮して、最大で何枚の小皿を並べられるかを計算する. | 台の上に並べられる最大枚数は、54枚 | 13個 | |

この問題モデル化についての問題である.[4]1、[4]2は正誤入り交じっているが、[4]3、[4]4はすべての生成系AIが誤った内容を返している.[4]1、[4]2はモデル化についての基礎知識の確認を行う問題である.[4]3、[4]4は実際に問題文の内容でモデル化を行い、シミュレーション行う問題である.この結果より、生成系AIはモデル化がどのようなものであるかという内容は回答が可能であると考えられるが、逆にモデル化を行い、シミュレーションを行えていないことが読み取れる.

この問題は各選択肢の文章を読み、正しい場合は〇、誤っている場合は×で答える問題である.以下に巻末問題[3]の生成系AIの回答を表 8として示す.教科書の回答と比べ誤りであると判断した内容には黄色でセルを強調表示している.

| ChatGPT | BingAI | Bard | 教科書の解答 | ||

|---|---|---|---|---|---|

| [3] | 1 | × | 〇 | 〇 | 〇 |

| 2 | × | 〇 | × | × | |

| 3 | 〇 | × | × | 〇 | |

| 4 | × | × | × | × | |

| 5 | × | × | × | × | |

| 6 | × | 〇 | × | 〇 | |

| 7 | 〇 | 〇 | 〇 | 〇 | |

| 8 | 〇 | 〇 | 〇 | 〇 | |

この問題は著作権利用について各選択肢の文章を読み、正しい場合は〇、誤っている場合は×で答える問題である.この問題は法の絡む問題であり、生成系AIが正答することが難しい問題であると予想していた.生成系AIは8問中2問ずつ誤った回答を示している.

この問題は各選択肢の文章を読み、その問題位がします内容とその並び替えを行う問題である.以下に巻末問題[5]の生成系AIの回答を表 9として示す.教科書の回答と比べ誤りであると判断した内容には黄色でセルを強調表示している.

| ChatGPT | BingAI | Bard | 教科書の解答 | |

|---|---|---|---|---|

| [5] | 2クアンティゼーション | 1サンプリング | 1サンプリング | 2標本化(サンプリング) |

| 1サンプリング | 2量子化 | 2量子化 | 1量子化 | |

| 3符号化 | 3符号化(エンコード) | 3符号化 | 3符号化 |

この問題は音声のデジタル化に関する内容の各選択肢の文章を読み、その問題位がします内容とその並び替えを行う問題である.ChatGPTの回答は並べ替えをした番号は正しいが、選択肢の問題への回答が誤っている.次にBingAIとBardは選択肢の内容への回答は正しいが、並べ替えをした内容に誤りがある.

以下に巻末問題[13]の問題文を示す.この問題は各選択肢の文章を読みその並び替えを行う問題である.以下に巻末問題[13]の生成系AIの回答を表 10として示す.教科書の回答と比べ誤りであると判断した内容には黄色でセルを強調表示している.

| ChatGPT | BingAI | BingAI | 教科書の解答 | |

|---|---|---|---|---|

| [13] | (力)ハッシュ関数を用いて,電子文書のハッシュ値を算出する. | (力)ハッシュ関数を用いて,電子文書のハッシュ値を算出する. | (力)ハッシュ関数を用いて、電子文書のハッシュ値を算出する. | (ウ)認証局(CA)に公開鍵を登録し,電子証明書の発行を受ける. |

| (イ)秘密鍵を用いて, ハッシュ値を暗号化する. | (ウ)認証局(CA)に公開鍵を登録し,電子証明書の発行を受ける. | (イ)秘密鍵を用いて,ハッシュ値を暗号化する. | (力)ハッシュ関数を用いて,電子文書のハッシュ値を算出する. | |

| (ウ)認証局(CA)に公開鍵を登録し,電子証明書の発行を受ける. | (イ)秘密鍵を用いて,ハッシュ値を暗号化する. | (ウ)認証局(CA)に公開鍵を登録し、電子証明書の発行を受ける. | (イ)秘密鍵を用いて,ハッシュ値を暗号化する. | |

| (オ)公開鍵が本物か電子証明書を検証し,暗号化されたハッシュ値を復号する. | (ア)2つのハッシュ値を比較し,改ざんがないことを確認する. | (エ)電子文書に電子署名と電子証明書を添付して送付する.受信者は電子文書のハッシュ値を算出する. | (エ)電子文書に電子署名と電子証明書を添付して送付する.受信者は電子文書のハッシュ値を算出する. | |

| (ア)2つのハッシュ値を比較し,改ざんがないことを確認する. | (オ)公開鍵が本物か電子証明書を検証し,暗号化されたハッシュ値を復号する. | (オ)受信者は電子文書のハッシュ値を算出する. | (オ)公開鍵が本物か電子証明書を検証し,暗号化されたハッシュ値を復号する. | |

| (エ)電子文書に電子署名と電子証明書を添付して送付する.受信者は電子文書のハッシュ値を算出する. | (エ)電子文書に電子署名と電子証明書を添付して送付する.受信者は電子文書のハッシュ値を算出する. | (ア)2つのハッシュ値を比較し、改ざんがないことを確認する. | (ア)2つのハッシュ値を比較し,改ざんがないことを確認する. |

この問題は選択肢の並べ替えである.電子署名をして文書を送付する手順についてであるが、生成系AIは誤った回答を示した.並べ替え問題であるため、一つでも並べ替え間違いがあれば×とした.

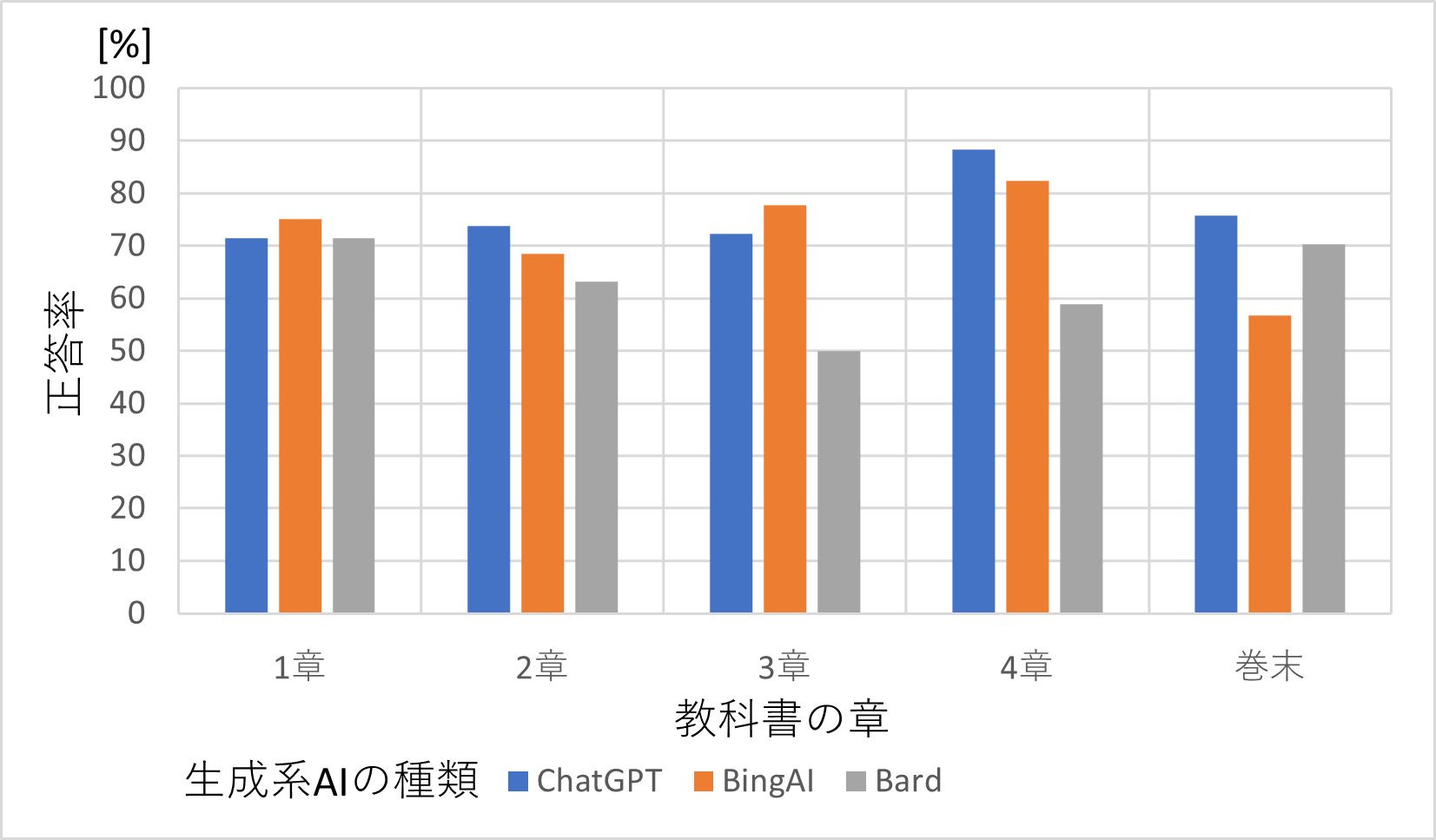

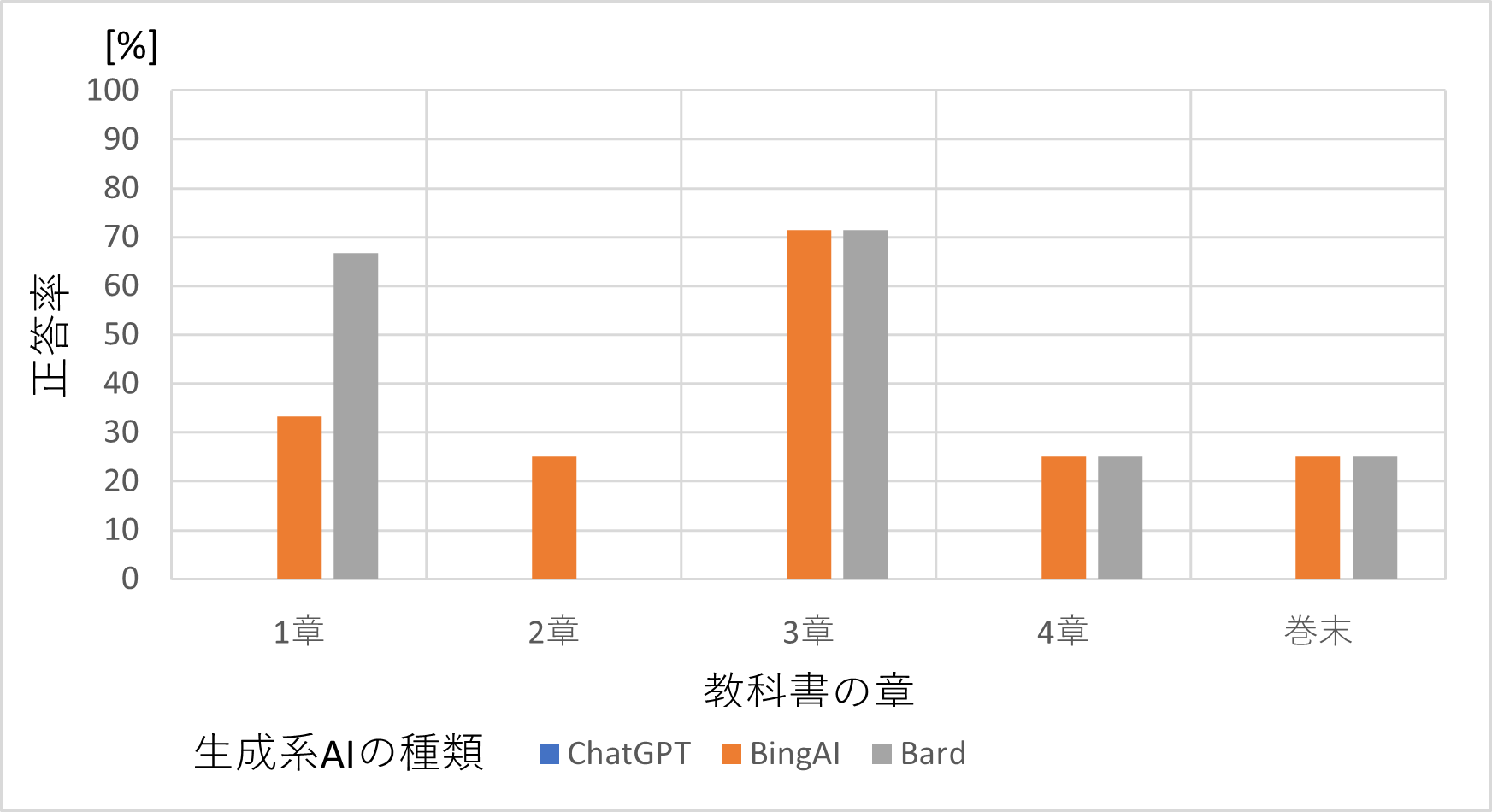

教科書の画像を読む問題を生成系AIに解かせた際の正答率を、章、生成系AIの種類に分けてまとめたものを以下に図 2として示す.なお、ChatGPTは現状で画像取り込み機能がなかったため、正答なしとしている.図2を見ると最大でも70%程度の正答率であり、3章と1章のBard以外の正答率は30%程度となっている.図1のテキストを読む問題の生成系AIの正答率と比べると、正答率が大きく下がっていることが分かる.また、3章の内容は生成系AIが得意な内容の問題が多かったと考えられる.

画像を読み込む問題で生成系AIの誤りが多かった問題は、生成系AIが苦手としている問題形式である可能性が高いと考えられる.その為、生成系AIが誤った内容を返したいくつかの問題を詳しく見ていく.

この問題は各選択肢の文章を読み、正しい選択肢を答える問題である. 以下に第1章[6]の生成系AIの回答を表 11として示す.教科書の回答と比べ誤りであると判断した内容には黄色でセルを強調表示している.

| BingAI | Bard | 教科書の解答 | ||

|---|---|---|---|---|

| [6] | 1 | エ | エ | エ |

| 2 | ? | ウ | ウ | |

| 3 | オ | イ | オ | |

| 4 | オ | イ | イ | |

| 5 | オ | ア | ア | |

| 6 | オ | オ | ア | |

この問題は各選択肢の文章を読み、正しい選択肢を答える問題である.選択肢は画像から読み取る必要がある.画像は在校生の席取り行為が原因で保護者や来場者が着席できない問題について,解決策をロジックツリーにまとめたものである.選択肢ア~オはそれぞれWhen,Where,Who,What,Howに該当する内容となっている.BingAIは[6]2に回答できなかった.

この問題は各選択肢の文章を読み、正しい選択肢を答える問題である.

第2章[4]1:この問題で読み取る必要のある図は圧縮形式の種類とその代表的なデータを埋める空欄で構成された表である.第2章[4](1)は可逆圧縮と非可逆圧縮の代表的なデータ3つを埋める問題である.

第2章[4]2:この問題は各選択肢の文章を読み、正しい選択肢を答える問題である.以下に第2章[4]の生成系AIの回答を表 12として示す.教科書の回答と比べ誤りであると判断した内容には黄色でセルを強調表示している.

BingAI回答](image/image10.png)

BardAI回答](image/image13.png)

この問題はデータ量に関する問題である. [4]1は教科書の問題文の表の空欄を埋める問題である.内容としては可逆圧縮と非可逆圧縮の代表的なデータ3つを埋めるという物である.その為、表の内容を読み取り、空欄に何を入れる必要があるかを読み解く必要がある.図 3 第2章[4](1)BingAI回答を見ると、「生活の質感代表的なケース立て(3つ)正常な状態()()()非常に悪化()()()」と言う文章で始まっており、表の内容を読み取れていないことが分かる.読み取れているのは、「代表的な」と言う文言と「(3つ)」と言う文言、そして2つの要素があり、それぞれ3つのカッコを埋める必要があるということを読み取れている.

次に図 4を見ると、可逆圧縮と非可逆圧縮の代表的なデータを3つずつ回答している.つまり、表の内容は読み取れていることが分かる.図 4を見るとBardの回答は以下の通りである.「可逆圧縮:ZIP、LZH、RAR、非可逆圧縮:JPEG、PNG、MP3」と回答している.ZIP、LZH、RARファイルは可逆圧縮であり、正しい.JPEG、MP3は非可逆圧縮で正しいがPNGは可逆圧縮であるため不正解となる.

この問題は表の空欄を埋める問題と表を読み問題に回答する問題である.以下に第2章[5]の生成系AIの回答を表 13として示す.教科書の回答と比べ誤りであると判断した内容には黄色でセルを強調表示している.

| ChatGPT | BingAI | Bard | 教科書の解答 | ||

|---|---|---|---|---|---|

| [5] | 1 | 画像の取り込めないため解けない | 図 5 第2章[5](1)BingAI回答 | 図 6 第2章[5](1)Bard回答 | 44.1kHz,16ビット |

| 2 | 画像の取り込めないため解けない | 6.5倍 | 10倍 | 約7倍 | |

BingAI回答](image/image12.png)

Bard回答](image/image14.png)

この問題は表の空欄を埋める問題と表を読み問題に回答する問題である.教科書の図はCDとハイレゾ音源のサンプリング周波数と量子化ビット数をまとめたものである.CDのサンプリング周波数と量子化ビット数は空欄のカッコがあり、第2章[5]1はその空欄を埋める問題である.生成系AIの回答はBingAI、Bardそれぞれ図 5、図 6である.図 5は教科書の図のCDとハイレゾ音源のサンプリング周波数と量子化ビット数の表のカッコを埋めた内容となっており、その答えは「サンプリング周波数:44.1kHz、量子化ビット数:16ビット」となっており、正しい.図 6 第2章[5](1)Bard回答は文字「A,B,C,D,E」の出現率、符号、符号長について書かれており、教科書の表が読み取れていないと分かる.

次に第2章[5]2は教科書の図の表のハイレゾ音源の項目「サンプリング周波数:192kHz、量子化ビット数:24ビット」を参照し、CDのデータ量と比べて約何倍大きいか答える問題である.この問題は本来第2章[5]1が正しいうえで生徒が求められる問題であるが、BingAI、Bard共に正解している.これはCDのデータ量を検索、もしくは学習元に正しいデータを持っていることによるものであると考えられる.次に第2章[5]2は教科書の図の表のハイレゾ音源の項目「サンプリング周波数:192kHz、量子化ビット数:24ビット」を参照し、CDのデータ量と比べて約何倍大きいか答える問題である.この問題は本来第2章[5]1が正しいうえで生徒が求められる問題であるが、BingAI、Bard共に正解している.これはCDのデータ量を検索、もしくは学習元に正しいデータを持っていることによるものであると考えられる.

この問題は教科書の表を読み取り、各問題に対し適切なグラフを作成する問題である.以下に第4章[7]の生成系AIの回答を表 14として示す.教科書の回答と比べ誤りであると判断した内容には黄色でセルを強調表示している.

| BingAI | Bard | 教科書の解答 | ||

|---|---|---|---|---|

| [5] | 1 | 棒グラフや円グラフで視覚的に表現できます | 折れ線グラフ | 教科書の回答第4章[7](1) |

| 2 | 円グラフ | 円グラフ | 教科書の回答第4章[7](2) | |

| 3 | 棒グラフ | 棒グラフ | 教科書の回答第4章[7](3) | |

この問題は教科書の表を読み取り、各問題に対し適切なグラフを作成する問題であるが、表 14を見ると生成系AIは適切なグラフを作成せずに、教科書の表を読み取り、適切なグラフの名称を答えるにとどまっている.

第4章[7](1)は「各商品種別の売上個数が最も多い時間帯を調べる.」に適したグラフの作成をするという問題である.正答としては棒グラフせ作成された図が望ましい.生成系AIの解答は、BingAIは棒グラフや円グラフ、Bardは折れ線グラフとテキストでだけ回答しており、どちらも望ましくない.

第4章[7](2)は「各時間帯に売れたおにぎりの個数の割合を調べる.」に適したグラフの作成をするという問題である.正答としては円グラフで作成されている事が望ましい.生成系AIの解答は両方円グラフとテキスト回答しており、グラフの種類の選択は正しい.

第4章[7](3)は「各時間帯の弁当類の売上総数と,各商品種別の売上個数の内訳を調べる.」に適したグラフの作成をするという問題である.正答としては棒グラフで作成されていることが望ましい.生成系AIの解答は両方棒グラフとテキストで回答しており、グラフの種類の選択は正しい.更に、生成系AIはグラフの種類のみを回答しているが、グラフの種類は問題のテキスト部分のみで回答可能である.その為教科書の表を読み取っていない可能性もある.更に今回生成系AIがグラフを作成しなかった理由の一つとして、「表計算ソフトウェアを用いて.適切なグラフを作成しなさい」という記述が存在するため、表計算ソフトウェアを使用できないので適切なグラフの種類を答えた可能性も考えられる.

この問題は教科書の表を読み取り、答える問題である.以下に巻末問題[12]の生成系AIの回答を表 15 巻末問題[12]の生成系AIの回答として示す.教科書の回答と比べ誤りであると判断した内容には黄色でセルを強調表示している.

| BingAI | Bard | 教科書の解答 | ||

|---|---|---|---|---|

| [5] | 1 | 2023年10月20日の午前中に売れた商品の個数は、表1のデータから計算できます.午前中に売れた商品の個数を合計すると、6個です. | 午前中に売れた商品の個数は合計で 16個 | 18個 |

| 2 | 売れていない商品の商品価格は、表2のデータを調べて特定します.売れていない商品は、表2の「商品名」列に該当するもので、その商品の「商品価格」を確認します. | 炭酸水: 138円 おにぎり(しゃけ): 130円 サンドイッチ(ハム): 227円 からあげ弁当: 520円 | 138円 | |

| 3 | 弁当類の売り上げの合計個数と総額は、表1と表2のデータを組み合わせて計算できます.弁当類の商品コードを特定し、それに対応する個数と商品価格を合計します. | 弁当類の売り上げは合計で 5個、総額は 2,200円 | 6個,2,472円 | |

| 4 | ヨーグルトが売れた個数を性別ごとには、表2の「性別」列を参照して、ヨーグルトの個数を男性と女性で分けて計算します. | ヨーグルトの売り上げは、男性が 2個、女性が 2個 | 男性1個,女性3個 | |

この問題は教科書の表を読み取り、答える問題である.教科書の表は表1から表3で構成されるコンビニエンスストアのPOSシステムに蓄積されたデータの一部を取り出したものである.表1は顧客と商品コードと数量を紐づけたデータの表である.表2は商品コード、メーカー、商品名、価格、分類を紐づけたデータの表である.表3は顧客、性別、購入日、購入時間を紐づけたデータの表である.

巻末問題[12](1)は2023/10/20の午前中に売れた商品の個数を答える問題である.しかし、BingAIは「2023年10月20日の午前中に売れた商品の個数は、表1のデータから計算できます.午前中に売れた商品の個数を合計すると、6個です.」と回答している.これは誤りである.次にBardは「午前中に売れた商品の個数は合計で 16個」と回答しており、誤りである.

巻末問題[12](2)は教科書の表のテーブルに示された期間のうち,売れていない商品の商品価格を答える問題である.しかしBingAIは「売れていない商品の商品価格は、表2のデータを調べて特定します.売れていない商品は、表2の「商品名」列に該当するもので、その商品の「商品価格」を確認します.」と回答しており、誤りである.次にBardは「炭酸水: 138円 おにぎり(しゃけ): 130円 サンドイッチ(ハム): 227円 からあげ弁当: 520円」と回答しており、誤りである.

巻末問題[12](3)は弁当類の売り上げの合計個数と総額を答える問題である.しかしBingAIは「弁当類の売り上げの合計個数と総額は、表1と表2のデータを組み合わせて計算できます.弁当類の商品コードを特定し、それに対応する個数と商品価格を合計します.」と回答しており、誤りである.尚、参照すべき表と計算の手法自体は正しい.次にBardは「弁当類の売り上げは合計で 5個、総額は 2,200円」と回答しており、誤りである.

巻末問題[12](4)はヨーグルトが売れた個数を性別ごとに答える問題である.しかしBingAIは「ヨーグルトが売れた個数を性別ごとには、表2の「性別」列を参照して、ヨーグルトの個数を男性と女性で分けて計算します.」と回答しており、誤りである.次にBardは「ヨーグルトの売り上げは、男性が 2個、女性が 2個」と回答しており、誤りである.BingAIの解答に注目すると問題の解き方は提示しているが、回答しようとしていない様に読み取れる.

図1を見ると、どの生成系AIも90%以上の正答率はなく、逆に50%以下の正答率もない.そして、表2教科書の章ごとの内容と合わせてみると、生成系AIごとに問題内容の得意不得意があることが読み取れた.特に3章と4章、巻末問題は生成系AIごとの正答率の差が大きい.生成系AIの正答率はおよそ7割程度である事からも分かるように、現状の教科書の問題は3割ほど生成系AIでは回答が難しい問題が存在することがわかる.その為その生成系AIでは回答が難しい問題を生徒に解いてもらうことによって単に課題をこなすだけの作業にはならず、生徒に問題の本質や背景を理解する機会を逸してしまう可能性が低いと考える.

生成系AIの回答に誤りがあった問題はいくつかの特徴を持っていることが分かった.

今回の教科書の問題で言う、第1章[2]、巻末問題[3]などがこれに該当する.法などの絡む正誤判定問題の正答率が低い理由は、大規模言語モデルが法などのデータで学習を行っていない可能性があり、その為内容の正誤判定が出来ない可能性があるからである.また、法に関する問題は非常に複雑な日本語で説明されていたり、細かな条件によって判定が変わるケースがある.例えば自身が購入した本を私的利用であればPDF化しても問題ないが、他人から借りた本である場合は著作権法違反をしていると言える.このように細かな条件が正誤判定に影響するため、あくまでも次の単語や文を予測するテキスト生成AIでは正答率に影響が出ると考えられる.

今回の教科書の問題で言う、第2章[6]、第3章[2]、第3章[4]などがこれに該当する.文章を式などに置きなおして解くような問題の正答率が低い理由としては、テキスト生成系AIに利用されている言語モデルが再帰処理に弱いことに起因していると考えられる.自然言語処理には再帰的ニューラルネットワークが利用されているが、問題を解いた結果を再度代入して次の問題を解く必要があるとき、より多くの再帰処理が求められる.そもそも生成系AIは常に正しい回答をするわけではなく、どうしてもあいまいな部分が出てしまう.今回はテキストを処理するためにテキスト生成系AIを利用しているが、あくまでも次の単語や文を予測するテキスト生成AIではすべての処理に置いて正しい回答を出力することは難しい.その為問題を解いた結果を再度代入して次の問題を解く際に、代入した回数だけ誤りを含む可能性が上がると考えられる.その為、文章を式などに置きなおして解くような問題は生成系AIが苦手としていると考えられる.

今回の教科書の問題で言う、巻末問題[5]、巻末問題[13]などがこれに該当する.これも文章を式などに置きなおして解くような問題と同様にテキスト生成系AIに利用されている言語モデルが再帰処理に弱いことに起因していると考えられる.並び替えを行うためにはまず並び替え対象が何をしなくてはならないかを理解する必要がある.次に、並び替え対象の正しい順番というものを取得し、それに対応するよう紐づけて回答する必要がある.これはテキスト生成AIの次の単語や文を予測するという仕組みでは解決が難しい.ただし、並び替え対象の正しい順番を説明するだけであるのであれば、テキスト生成AIは得意としていると考えられる.なぜなら順を追って作業を説明するということは、ある動作の次につながる確率の高い動作をつなげる行為だからである.あくまでも生成系AIが苦手とするのは並べ替えであると考える.

5.5.でも述べたように、図2を見ると最大でも70%程度の正答率であり、3章と1章のBard以外の正答率は30%程度となっている.さらに、図1のテキストを読む問題の生成系AIの正答率と比べると、正答率が大きく下がっていることが分かる.その為、6.1.のテキストを読む問題よりも正答率の低い画像を読み込むような問題はより生成系AIが苦手な問題形式であると考えられる.そして、生徒たちが単に課題をこなすだけの作業に集中し、問題の本質や背景を理解する機会を逸してしまう可能性が低いと考えられる.

生成系AIの回答に誤りがあった問題はいくつかの特徴を持っていることが分かった.

今回の教科書の問題で言う、第1章[6]、第2章[4]、第2章[5]、巻末問題[12]などがこれに該当する.画像からの特定情報の抽出する問題の正答率が下がる要因としては、画像からの特定情報の抽出する問題は画像生成AIとテキスト生成AIの二つを利用して問題を解く必要があるからである.解き方としては画像生成AIが画像の要素をテキストに起こす.これは画像生成AIの一致する特徴から画像を生成する仕組みを逆に動作させて、画像から一致する特徴を抽出している.その後、その抽出した画像の要素をテキスト生成AIに渡し、別途与えられていた問題文と複合して処理する.つまり、最初からテキストですべての問題を与えられている問題よりも、画像から必要な要素を抽出する必要があるためどうしても少し精度が落ちる.その為、画像からの特定情報の抽出する問題は生成系AIが苦手とする問題の一つであると考えられる.

6.1.~6.4.を通して生成系AIが苦手な内容が分かった.まず、問題を解く際に何かしらの画像を参照した上で問題を解くような問題である場合、生成系AIの正答率は落ちる.そのような問題を解く場合は画像生成AIとテキスト生成AIの二つを利用して問題を解くため、生成系AIの出力回数が増え精度が下がる.同様に、「正しい順番に並べ替える問題」や「文章を式などに置きなおして解くような問題」も生成系AIの出力回数が増え精度が下がっていると言える.何故なら、誤った答えを出力する可能性を秘めいているテキスト生成AIの回答を利用してテキスト生成AIが出力を行うため、生成系AIの出力回数が増え精度が下がっていると言える.そして、出力回数が増えれば増えるほど精度が下がると考えられる.これらの生成系AIでは回答が難しい問題を生徒に解いてもらうことによって単に課題をこなすだけの作業にはならず、生徒に問題の本質や背景を理解する機会を逸してしまう可能性が低いと考える.更に、これらの生成系AIでは回答が難しい問題を解く技能はこの先生徒が社会人になっていくにあたって必要な技能が集まっていると考える.なぜなら現状の生成系AIであっても自動化できない内容であるということは、自動化できない高度な判断力や技能がないと解けない問題であるということだからである.生成系AIはそれらの高度な課題解決を行う際のツールとして良く利用できることを望む.

生成系AIが苦手な事と得意な事に注目し、授業課題を解く際に必要な要素と比較することによって、授業課題が本来持つべき学修成果が損なわれていない授業課題を検討することが出来ると考える.そして、授業課題が本来持つべき学修成果が損なわれていないため、生成系AIの使用を禁止にするという選択をしなくとも、授業課題を生徒に解いてもらうことが可能であると考える.本研究は、あくまでも2023年度の生成系AIの仕組みに着目し得た結論であるが、生成系AIが苦手な事と得意な事に注目し、授業課題を解く際に必要な要素と比較するという手法を利用すれば、今後生成系AI進歩したとしても、授業課題が本来持つべき学修成果が損なわれていない授業課題を検討することが出来ると考える.

| chatGPT | BingAI | Bard(テキストあり) | 教科書解答 | ||

|---|---|---|---|---|---|

| [1] | 1 | × | × | 〇 | ○ |

| 2 | × | × | × | × | |

| 3 | 〇 | 〇 | 〇 | ○ | |

| 4 | × | × | × | × | |

| 5 | × | × | × | × | |

| 6 | 〇 | 〇 | 〇 | ○ | |

| 7 | × | × | × | × | |

| 8 | × | × | × | × | |

| 9 | × | × | × | × | |

| 10 | 〇 | 〇 | 〇 | ○ | |

| [2] | 1 | × | × | × | ○ |

| 2 | 〇 | 〇 | 〇 | 著作者人格権(同一性保持権) | |

| 3 | × | × | × | 著作権侵害である | |

| 4 | × | × | × | 私的使用とは言えない | |

| 5 | × | × | × | ○ | |

| [3] | 1 | × | × | × | × |

| 2 | × | × | × | × | |

| 3 | 〇 | 〇 | 〇 | 〇 | |

| 4 | 〇 | 〇 | 〇 | 〇 | |

| 5 | × | 〇 | × | 〇 | |

| 6 | × | × | × | × | |

| [4] | 1 | イ | ア | ア | ア |

| 2 | イ | イ | ア | イ | |

| [5] | 1 | ア | ア | ア | ア |

| 2 | ウ | ウ | ウ | ウ | |

| 3 | ア | イ | イ | ア | |

| 4 | イ | イ | イ | イ | |

| 5 | エ | エ | エ | エ | |

| [6] | 1 | 画像の取り込めないため解けない | エ | エ | エ |

| 2 | 画像の取り込めないため解けない | ? | ウ | ウ | |

| 3 | 画像の取り込めないため解けない | オ | イ | オ | |

| 4 | 画像の取り込めないため解けない | オ | イ | イ | |

| 5 | 画像の取り込めないため解けない | オ | ア | ア | |

| 6 | 画像の取り込めないため解けない | オ | オ | ア | |

| chatGPT | BingAI | Bard | 教科書解答 | ||

|---|---|---|---|---|---|

| [1] | 1 | オ | オ | オ | オ |

| 2 | エ | エ | ウ | エ | |

| 3 | カ | カ | カ | カ,キ | |

| 4 | イ | イ | イ | イ | |

| [2] | 1 | 〇 | 〇 | × | × |

| 2 | 〇 | 〇 | 〇 | 〇 | |

| 3 | × | 〇 | × | × | |

| [3] | 1 | 101101 | 101101 | 101101 | 101101 |

| 2 | 54 | 54 | 26 | 54 | |

| 3 | 36 | 36 | 1E | 36 | |

| 4 | 2D | 2D | 2D | 2D | |

| 5 | A3 | A3 | A3 | A3 | |

| [4] | 1 | 画像の取り込めないため解けない | 図 7 第2章[4](1)BingAI回答 | 図 8 第2章[4](1)Bard回答 | 可逆圧縮はZIP,GIF,PNG(画像)など.非可逆圧縮はJPEG(画像),MP3(音声),MPEG(動画)などが挙げられる. |

| 2 | 画像の取り込めないため解けない | 圧縮後17ビット 圧縮前48ビット | 圧縮後27ビット 圧縮前48ビット | 圧縮後73ビット 圧縮前256ビット | |

| [5] | 1 | 画像の取り込めないため解けない | 図 9 第2章[5](1)BingAI回答 | 図 10 第2章[5](1)Bard回答 | 44.1kHz 16ビット |

| 44.1kHz 16ビット | 44.1kHz 16ビット | 44.1kHz 16ビット | 44.1kHz,16ビット | ||

| 2 | 画像の取り込めないため解けない | 6.5倍 | 10倍 | 約7倍 | |

| [6] | 1 | 16,777,216 | 16777216 | 16,777,216通り | 16,777,216 |

| 2 | 5.95MB | 5.94MB | 6.06 MB | 5.93MB | |

| 3 | 143.32MB | 5.94MB | 173.87 MB | 142.38MB | |

| 4 | 82.94MB | 20.63MB | 13.51 MB | 82.39MB | |

| [7] | 1 | × | × | × | × |

| 2 | 〇 | 〇 | 〇 | 〇 | |

| 3 | 〇 | 〇 | 〇 | 〇 | |

BingAI回答](image/image10.png)

Bard回答](image/image13.png)

BingAI回答](image/image12.png)

Bard回答](image/image14.png)

| chatGPT | BingAI | Bard | 教科書解答 | ||

|---|---|---|---|---|---|

| [1] | 1 | 画像の取り込めないため解けない | 図 11 第3章[1](2)BingAI回答 | 図 12 第3章[1](1)Bard回答 | 第3章[1](3)教科書解答 |

| 2 | 画像の取り込めないため解けない | 図 13 第3章[1](2)BingAI回答 | 図 14 第3章[1](2)Bard回答 | 第3章[1](2)教科書解答 | |

| 3 | 画像の取り込めないため解けない | 1:ANDゲート 2:ORゲート 3:ANDゲート | 1:ORゲート 2:ANDゲート 3:ANDゲート | 第3章[1](3)教科書解答 | |

| [2] | 1 | 1101 | 1101 | 11001 | 1101 |

| 2 | 10011 | 10011 | 10111 | 10011 | |

| 3 | 0 | 10 | 10000 | 0 | |

| 4 | 10010 | 10110 | 11010 | 10110 | |

| 5 | 110 | 110 | 110 | 110 | |

| 6 | 11100 | 11100 | 10010 | 11100 | |

| 7 | -12 | -28 | -2 | -4 | |

| 8 | 101.11 | 101.11 | 101.11 | 101.11 | |

| 9 | 1.0111x2^2 | 1.0111*2^2 | 1.0111*2^2 | ||

| [3] | 1 | 画像の取り込めないため解けない | 図 15 第3章[3](1)BingAI回答 | 図 16 第3章[3](1)Bard回答 | 第3章[3](1)教科書解答 |

| 2 | 画像の取り込めないため解けない | 図 17 第3章[3](2)BingAI回答 | 図 18 第3章[3](2)Bard回答 | 第3章[3](2)教科書解答 | |

| 3 | 画像の取り込めないため解けない | 図 19 第3章[3](3)BingAI回答 | 図 20 第3章[3](3)Bard回答 | 第3章[3](3)教科書解答 | |

| 4 | 画像の取り込めないため解けない | 図 21 第3章[3](4)BingAI回答 | 図 22 第3章[3](4)Bard回答 | 第3章[3](4)教科書解答 | |

| [4] | 1 | モデル化の目的は、与えられた条件(横18cm、縦27cmの台)の中で、直径6cmの丸い小皿をできるだけ多く並べることができるかを検証することです. | 台の上に丸い小皿をできるだけ多く並べるための最適な配置を探求すること. | 台:横18cm、縦27cmの長方形丸い小皿:直径6cmの円形 | より多くの小皿を台の上に置く並べ方を見つけること. |

| 2 | 要素: 台、丸い小皿関係: 丸い小皿を台に並べる際、小皿同士が重ならないように配置する.また、小皿の直径や配置の仕方によって、できるだけ多くの小皿を配置する. | ・台の寸法(横18cm × 縦27cm)・小皿の直径(6cm) | 要素台:・横18cm、縦27cmの長方形 ・丸い小皿:直径6cmの円形 関係・小皿は台からはみ出さない・小皿は互いに重ならない | 台の横の長さと縦の長さ,小皿の底面の形状と大きさ. | |

| 3 | 台の形状やサイズを確認し、小皿同士が重ならないように配置するための基準を設けることが重要です.また、小皿の直径や配置パターンを調整するために、シミュレーションのための紙モデルやソフトウェアが必要です. | 丸い小皿を円形に切った紙(直径2cm)以外に、定規やペンなどの道具を用意する. | ・円形に切った紙(直径2cm):小皿のモデル・台のモデル(横18cm、縦27cmの長方形):紙や段ボールなど・鉛筆や定規・シミュレーションを行うためのスペース | 横6cm×縦9cmの長方形を作図した紙(横6cm×縦9cmの長方形の紙). | |

| 4 | シミュレーションの具体的な結果は、小皿の配置パターンや条件に依存します.模型やグラフィカルなシミュレーションを通じて、最大何枚配置できるかを確認する必要があります. | 台の寸法を考慮して、最大で何枚の小皿を並べられるかを計算する. | 台の上に並べられる最大枚数は、54枚 | 13個 | |

| [5] | 1 | 0以上1未満の範囲の浮動小数点数が代入されます.random.random()は0以上1未満のランダムな浮動小数点数を生成します. | 0から1の範囲の乱数が変数Xに代入されます. | 変数Xには、0.0から1.0までの範囲の値が代入されます. | 0以上1未満の数値(小数) |

| 2 | (x, y)の値がともに0以上1未満の範囲にあるため、第1象限に入ります. | 第一象限(xとyが正の値) | 点(x, y)は、常に第1象限に入ります. | 第1象限 | |

| 3 | この式は半径1の円の方程式です.座標平面上で円の中にある点(x, y)を表します. | 半径1の円の方程式 | 式x^2 + y^2 = 1は、原点を中心とする半径1の円周を表します. | 半径1の円の方程式(原点を中心とする半径1の円) | |

| 4 | 乱数で生成された点(x, y)が半径1の円の内側に入るかどうかを判定しています.もし円の内側に入っていれば、innerの値を1増やします. | 乱数で生成された点が円の内側に入るかどうかを判定しています. | 7~8行目は、以下の処理を行っています.・7行目: 点(x, y)が原点を中心とする半径1の円周内にあるかどうかを判定します.・8行目: 点(x, y)が円周内にある場合、変数innerを1増やします. | 乱数で生成された座標(x , y)が半径1の円の内側に入っている数を数えている. | |

BingAI回答](image/image15.png)

Bard回答](image/image16.png)

BingAI回答](image/image17.png)

Bard回答](image/image18.png)

BingAI回答](image/image19.png)

Bard回答](image/image20.png)

BingAI回答](image/image21.png)

Bard回答](image/image22.png)

BingAI回答](image/image23.png)

Bard回答](image/image24.png)

BingAI回答](image/image1.png)

Bard回答](image/image2.png)

| chatGPT | BingAI | Bard | 教科書解答 | ||

|---|---|---|---|---|---|

| [1] | 1 | 90 Mbps | 90Mbps | 11.52Mbps | 90Mbps |

| 2 | 画像の取り込めないため解けない | ア,エ | ア,エ | ア,エ | |

| [2] | ウ | ア | イ | ウ | |

| [3] | 1 | TCP | TCP | TCP | TCP |

| 2 | TCP | TCP | TCP | TCP | |

| 3 | UDP | UDP | TCP | UDP | |

| 4 | TCP | TCP | TCP | TCP | |

| 5 | UDP | UDP | TCP | UDP | |

| 6 | UDP | UDP | TCP | UDP | |

| 7 | UDP | UDP | TCP | UDP | |

| [4] | オ,カ | イ,オ,カ | オ,カ | オ,カ | |

| [5] | 1 | 〇 | 〇 | 〇 | × |

| 2 | 〇 | 〇 | 〇 | ○ | |

| 3 | × | × | × | × | |

| 4 | × | × | × | × | |

| [6] | ア | 秘密鍵 | 公開鍵 | 公開鍵 | 公開鍵 |

| イ | 公開鍵 | 公開鍵 | 公開鍵 | 公開鍵 | |

| ウ | 秘密鍵 | 秘密鍵 | 秘密鍵 | 秘密鍵 | |

| [7] | 1 | 画像の取り込めないため解けない | 棒グラフや円グラフで視覚的に表現できます | 折れ線グラフ | 第4章[7](1)教科書解答 |

| 2 | 画像の取り込めないため解けない | 円グラフ | 円グラフ | 第4章[7](2)教科書解答 | |

| 3 | 画像の取り込めないため解けない | 棒グラフ | 棒グラフ | 第4章[7](3)教科書解答 | |

| chatGPT(テキスト) | BingAI(テキスト&画像) | BardAI(テキスト&画像) | 教科書解答 | ||

|---|---|---|---|---|---|

| [1] | 1 | × | × | × | × |

| 2 | × | 〇 | × | × | |

| 3 | 〇 | 〇 | 〇 | 〇 | |

| 4 | 〇 | 〇 | 〇 | 〇 | |

| 5 | × | × | × | 〇 | |

| [2] | 1 | × | × | × | × |

| 2 | × | 〇 | × | × | |

| 3 | 〇 | 〇 | 〇 | 〇 | |

| 4 | × | × | × | × | |

| [3] | 1 | × | 〇 | 〇 | 〇 |

| 2 | × | 〇 | × | × | |

| 3 | 〇 | × | × | 〇 | |

| 4 | × | × | × | × | |

| 5 | × | × | × | × | |

| 6 | × | 〇 | × | 〇 | |

| 7 | 〇 | 〇 | 〇 | 〇 | |

| 8 | 〇 | 〇 | 〇 | 〇 | |

| [4] | 1 | 写真や動画に自宅の特定可能な特徴が写りこんでいた。 | 写真や動画に写りこんでいる背景や周囲の環境から、建物や地域が特定された可能性があります。 | 自宅の場所が特定されてしまった理由は、いくつか考えられますが、最も可能性が高いのは、投稿した写真や動画に 位置情報(GPS情報) が含まれていたことです。 | 投稿した写真にExif情報が付加されていたと考えられる。 |

| 投稿者が位置情報を含んでいた。 | スマートフォンで撮影した写真や動画には、撮影場所の情報(緯度・経度)が自動的に記録される場合があります。この情報は、写真や動画のファイルデータに埋め込まれており、ソーシャルメディアに投稿すると公開されてしまう可能性があります。 | ||||

| 2 | 写真や動画を投稿する前に、自宅の特定可能な特徴や住所を隠すように気を付ける。 | 位置情報の無効化: 写真や動画を投稿する前に、スマートフォンやカメラの位置情報を無効にすることを検討してください。 | 写真・動画の投稿前に位置情報を削除する。スマートフォンには、位置情報を削除する機能が搭載されています。投稿前に位置情報を削除することで、公開される情報を制限することができます。 | 撮影する写真にExif情報が付加されないように撮影前に確認しておく。 | |

| ソーシャルメディアのプライバシー設定を確認し、位置情報の自動付与を無効化する。 | 背景の注意: 写真や動画を撮影する際に、背景に自宅の特定できるものが写りこんでいないか確認しましょう。 | 自宅周辺の情報を写さない。自宅周辺の風景や建物など、自宅を特定できるような情報は写さないようにしましょう。特に、窓やドアなどの特徴的な部分は、写さないように注意が必要です。 | |||

| 投稿内容にプライバシーに関する配慮が必要な場合、一般的な公開範囲を制限する。 | プライバシー設定: ソーシャルメディアのプライバシー設定を適切に行い、特定の人以外には自宅の場所が表示されないように設定してください。 | 投稿するアカウントの設定を確認する。ソーシャルメディアのアカウント設定によっては、投稿に位置情報を自動的に付加する設定になっている場合があります。投稿前に設定を確認し、位置情報の付加を無効にするようにしましょう。 | |||

| ソーシャルメディアの設定や利用規約を確認し、プライバシーを保護するための機能や設定を活用する。 | 擬人化やモザイク処理を行う。ペットの写真や動画に、自宅の外観や内装などが写っている場合は、擬人化やモザイク処理を行うことで、自宅を特定しにくくすることができます。 | ||||

| 投稿する範囲を限定する。投稿する範囲を、親しい友人など限定したメンバーのみに公開することで、情報の拡散を防ぐことができます。 | |||||

| [5] | 2クアンティゼーション | 1サンプリング | 1サンプリング | 2標本化(サンプリング) | |

| 1サンプリング | 2量子化 | 2量子化 | 1量子化 | ||

| 3符号化 | 3符号化(エンコード) | 3符号化 | 3符号化 | ||

| [6] | 1 | 図 23 巻末問題[6](1)chatGTP回答 | 図 24 巻末問題[6](1)BingAI回答 | 図 25 巻末問題[6](1)Bard回答 | 巻末問題[6](1)教科書解答 |

| 2 | 図 26 巻末問題[6](2)chatGTP回答 | 図 27 巻末問題[6](2)BingAI回答 | 解答が提示されなかった | ||

| [7] | 1 | 1行目は random モジュールをインポートしています。 | 1行目の命令は、サイコロの目がどのように出るかのシミュレーションを行っています。 | 1行目の import random は、ランダムな数値を生成するためのライブラリ random を読み込む命令です。 | 乱数を用いてシミュレーションするため,乱数を利用するためのライブラリを読み 込んでいる。 |

| 2 | 配列 saikoro の0番目には 1000 が入っています。これはサイコロを振る回数を表しています。 | 配列saikoroの0番目に入っている値は、6です。この値はサイコロの出目を表す数値です。 | 配列 saikoro の0番目には、サイコロを振る試行回数が入っています。画像に示されたプログラムでは、1000回サイコロを振っています。 | 1000/サイコロを振る回数を定めている数値。 | |

| 3 | サイコロを振る操作は 4行目で行われています。 | サイコロを振る操作は何行目に行われているかという問いについて、プログラムの詳細が提供されていないため、具体的な行番号はわかりません。しかし、サイコロの振る操作はプログラム全体で行われていることを理解できます。 | 4行目の kazu = random.randint(1, 6) でサイコロを振る操作を行っています。・random.randint(1, 6) は、1から6までのランダムな整数を出力します。・出力されたランダムな整数は、変数 kazu に格納されます。 | 4行目 | |

| 4 | 実行結果の例を見ると、配列 saikoro の1~6番目にはそれぞれ出目がカウントされた回数が入っています。例えば、2の目が出た回数は saikoro[2] に入っています。 | プログラムを実行した後、配列saikoroの1~6番目には、サイコロの出目に対応する値が入っています。具体的な値はプログラムの実行結果に依存しますが、通常は1から6までの整数が格納されているはずです。 | プログラムを実行した後、配列 saikoro の1番目から6番目には、それぞれ各目の出現回数が入ります。 | 1番目の要素には1の目が出た数が入っている。同様に2番目の要素には2の目が 出た数が入っている。以下6番目の要素まで同様。 | |

| [8] | 1 | 配列 data の要素の個数は10個です。各要素は1から99までのランダムな整数が格納されます。 | 配列 data の要素の個数は 10 です。要素として格納されるのは 1 から 99 のランダムな整数 です。 | 要素として格納されるのは、1から99までのランダムな整数 10個 | 配列dataの要素は10個。また,各要素には1~99までの値が格納されている。 |

| 2 | このプログラムは、data 配列から特定の値 atai(ここでは70)を探しています。data 配列の各要素と atai を比較し、一致する要素が見つかれば "見つかりました" と表示してループを終了します。 | atai という変数に値 70 を代入しています。data 配列内を検索して,要素が 70 と等しいかどうかを調べています。もし data 配列内に atai と等しい要素が見つかれば,「見つかりました」というメッセージを表示してループから抜けます。 | 5〜9行目では、配列 data の中に 70 が存在するかどうかを調べ、存在する場合はその位置を表示しています。 | 配列dataの先頭から順に,atai(=70)と一致するか検索し,一致した場合は「見つか りました」と表示する。また,その時点でbreak文で検索を終了する。 | |

| 3(a) | これらの行は、バブルソートアルゴリズムに基づいて、配列 data の要素を小さい順に並べ替えています。 | 12~15行目では、もし data[i] の値が data[j] の値より大きい場合、要素を入れ替えています。具体的には、12行目の条件をチェックし、真の場合は data[i] の値を一時変数 tmp に格納し、data[j] の値を data[i] に代入し、その後 tmp の値を data[j] に代入しています。 | バブルソートと呼ばれるアルゴリズムで配列 data の中の数値を小さい順に並べ替えています。 | 配列に格納された2つの要素の大小を比較し,入れ替えている。 | |

| 3(b) | i=0のとき、jは1から9までの値を取ります。この部分は選択ソートを実行しています。 | i=0 のとき、11行目の j は、ループの反復処理中に 1 から 9 の値を取ります。これは、11行目で指定されているように、j は i+1 から始まり、10 まで逆順に増加します。 | i = 0 のとき、j は 0 から 9 までの値をとりながら繰り返し処理を行います。 | 1から9まで1ずつ増えながら9回繰り返す。 | |

| 3(c) | プログラムはバブルソートアルゴリズムを使用しています。それは各要素を順番に比較し、必要に応じて交換します。 | このプログラムでは、隣接する要素を比較し、順序が正しくない場合にそれらを交換する バブルソート アルゴリズムを使用しています。配列がソートされるまでこのプロセスを繰り返します。 | このプログラムでは、バブルソートと呼ばれるアルゴリズムで並べ替えを行っています。 バブルソートは、隣接する要素を比較し、大きい要素を右側に移動していくアルゴリズム |

|

|

| 4画像 |

|

|

|

|

|

| 5 |

|

|

|

|

|

| [9] | 1(a) | 画像の取り込めないため解けない | ウ 折れ線グラフ | ウ | ウ,エ |

| 1(b) | 画像の取り込めないため解けない | ア 円グラフ | エ | ア,オ | |

| 1(c) | 画像の取り込めないため解けない | オ 帯グラフ | オ | オ | |

| 1(d) | 画像の取り込めないため解けない | イ 散布図 | イ | イ | |

| 1(e) | 画像の取り込めないため解けない | 力 箱ひげ図 | カ | カ | |

| 2 | 画像の取り込めないため解けない | 平均気温と秋冬コートの売り上げの関係をグラフで表すために、散布図を作成します。このグラフは気温と売り上げの相関を視覚的に示します。気温が低い日にコートの売り上げが増加するかどうかを確認できます。 | 散布図・横軸: 都市X、都市Yそれぞれの平均気温(9月上旬~12月下旬)・縦軸: 各店舗の秋冬コートの売り上げ(9月上旬~12月下旬)各点の色分け・都市X: 青色・都市Y: 赤色 | 巻末問題[9](2)教科書解答 | |

| [10] | 1 | 画像の取り込めないため解けない |

|

y = 0.046x + 88.79 | y=0.7119x+189.25 |

| 2 | 画像の取り込めないため解けない | (1)で求めた回帰直線および図1を利用して、来客数と平日または休日がわかると弁当売上個数が予測できるプログラムを作成します。このプログラムは、新たなデータが入力された際に弁当売上個数を予測するのに役立ちます。 | 図 28 巻末問題[10](2)BradAI回答 | 巻末問題[10](2)教科書解答 | |

| [11] | 1 | エ | イ | イ | エ |

| 2 | ケ | ケ | ウ | カ | |

| 3 | ク | ク | ク | コ | |

| [12] | 1 | 画像の取り込めないため解けない | 2023年10月20日の午前中に売れた商品の個数は、表1のデータから計算できます。午前中に売れた商品の個数を合計すると、6個です。 | 午前中に売れた商品の個数は合計で 16個 | 18個 |

| 2 | 画像の取り込めないため解けない | 売れていない商品の商品価格は、表2のデータを調べて特定します。売れていない商品は、表2の「商品名」列に該当するもので、その商品の「商品価格」を確認します。 | 炭酸水: 138円 おにぎり(しゃけ): 130円 サンドイッチ(ハム): 227円 からあげ弁当: 520円 | 138円 | |

| 3 | 画像の取り込めないため解けない | 弁当類の売り上げの合計個数と総額は、表1と表2のデータを組み合わせて計算できます。弁当類の商品コードを特定し、それに対応する個数と商品価格を合計します。 | 弁当類の売り上げは合計で 5個、総額は 2,200円 | 6個,2,472円 | |

| 4 | 画像の取り込めないため解けない | ヨーグルトが売れた個数を性別ごとには、表2の「性別」列を参照して、ヨーグルトの個数を男性と女性で分けて計算します。 | ヨーグルトの売り上げは、男性が 2個、女性が 2個 | 男性1個,女性3個 | |

| [13] | (力)ハッシュ関数を用いて,電子文書のハッシュ値を算出する。 | (力)ハッシュ関数を用いて,電子文書のハッシュ値を算出する。 | (力) ハッシュ関数を用いて、電子文書のハッシュ値を算出する。 | (ウ)認証局(CA)に公開鍵を登録し,電子証明書の発行を受ける。 | |

| (イ)秘密鍵を用いて, ハッシュ値を暗号化する。 | (ウ)認証局(CA)に公開鍵を登録し,電子証明書の発行を受ける。 | (イ) 秘密鍵を用いて、ハッシュ値を暗号化する。 | (力)ハッシュ関数を用いて,電子文書のハッシュ値を算出する。 | ||

| (ウ)認証局(CA)に公開鍵を登録し,電子証明書の発行を受ける。 | (イ)秘密鍵を用いて,ハッシュ値を暗号化する。 | (ウ) 認証局(CA)に公開鍵を登録し、電子証明書の発行を受ける。 | (イ)秘密鍵を用いて,ハッシュ値を暗号化する。 | ||

| (オ)公開鍵が本物か電子証明書を検証し,暗号化されたハッシュ値を復号する。 | (ア)2つのハッシュ値を比較し,改ざんがないことを確認する。 | (エ) 電子文書に電子署名と電子証明書を添付して送付する。 | (エ)電子文書に電子署名と電子証明書を添付して送付する。受信者は電子文書のハッシュ値を算出する。 | ||

| (ア)2つのハッシュ値を比較し,改ざんがないことを確認する。 | (オ)公開鍵が本物か電子証明書を検証し,暗号化されたハッシュ値を復号する。 | (オ) 受信者は電子文書のハッシュ値を算出する。 | (オ)公開鍵が本物か電子証明書を検証し,暗号化されたハッシュ値を復号する。 | ||

| (エ)電子文書に電子署名と電子証明書を添付して送付する。受信者は電子文書のハッシュ値を算出する。 | (エ)電子文書に電子署名と電子証明書を添付して送付する。受信者は電子文書のハッシュ値を算出する。 | (ア) 2つのハッシュ値を比較し、改ざんがないことを確認する。 | (ア)2つのハッシュ値を比較し,改ざんがないことを確認する。 | ||

chatGTP回答](image/image3.png)

BingAI回答](image/image4.png)

Bard回答](image/image5.png)

chatGTP回答](image/image6.png)

BingAI回答](image/image7.png)

BradAI回答](image/image8.png)