�}�P�@Tahoe�t�s�E�B���h�E�̕ω�

�H�w����� ���ʐM�H�w�� �S�N �{�� �N���Y

�ߔN�̃C���^�[�l�b�g���܂ރR���s���[�^�l�b�g���[�N�ł́A�����A�L�ш�ȉ����K�v�Ƃ���R���e���c�̕��y�Ȃǂɂ���āA�l�b�g���[�N�ш�̌����������I�ȗ��p�����߂���悤�ɂȂ��Ă����B���̒��Ŏ�ɗp�����Ă���v���g�R���Q�Ƃ��āATCP/IP���������邪�A�l�b�g���[�N�w�̃v���g�R���ł���IP�i�C���^�[�l�b�g�E�v���g�R���j�́A�f�[�^�̑���M���P�O�O���ۏ�͂��Ȃ����̂ł���A�����₤���߂ɏ�w�̃g�����X�|�[�g�w�Ńf�[�^��ۏႷ��TCP�i�g�����X�~�b�V�����E�R���g���[���E�v���g�R���j���p�����Ă���B�l�b�g���[�N�ш�̌����������I�ȗ��p�ɂ̓f�[�^�̕ۏ����TCP���t�s����A���S���Y�����傫���e�����Ă��邽�߁A�{�����ł�NS2�iNetwork Simulator Version.2�j��p����TCP�e�o�[�W�������t�s����̓������r���邱�Ƃ�ړI�Ƃ���B���̂��߂̎��O�m���Ƃ��āATCP�̗��j�ƌ��݂�TCP�Ɋւ���b������̏͂ň����B

TCP�iTransmission Control Protocol�j��1974�N�ɔ��\����A����܂�ARPANET�Ŏg�p����Ă���NCP�Ƃ͈Ⴂ����̐M���������肹���ɑ���M�҂̊ԂŐM�������m�ۂ���Ƃ������̂ł���B1978�N�ɂ�TCP����o�H���䕔��������IP�iInternet Protocol�j�Ƃ��ēƗ������邱�ƂɂȂ�A����܂�ARPANET�̒ʐM�����ׂĐ��䂵�Ă����ЂƂ̃v���g�R�����g�����X�|�[�g�w��TCP�A�l�b�g���[�N�w��IP�̂Q�K�w���琬�藧�悤�ɒ�`���ꂽ�B��ʓI�Ɍ����Ă���TCP/IP�͂����̑g�ݍ��킹��\������ł���B������TCP���t�s����@�\�����ڂ���Ă��炸�A1980�N�ɂ��t�s�������̘A���I�ȍđ��v���ɂ���ċN�����t�s���w�E���ꂽ�B�����t�s����̎w�E�����������Ƃ��āA1980�N�㔼�ɂ́w�G���h�m�[�h��̂ɂ���t�s����A���S���Y���x���l�Ă���A1990�N�㔼�ɂ́w���p�m�[�h��̂ɂ���t�s�A���S���Y���x���l�Ă��ꂽ�B�����Č��݂́A�w�G���h�m�[�h�ƒ��p�m�[�h�̗����x�����t�s������s�����݂��i�߂��Ă���B ���݁A���������t�s��������������A���p����Ă��邪�A��\�I�Ȃ��̂Ƃ���Tahoe�AReno�ANewReno�AVegas����������B

�ߔN�A�M�K�r�b�g�E�C�[�T�l�b�g�⍂������LAN�iIEEE802.11n)�ɑ�\����镨���w�̐i���ɂ��A�l�b�g���[�N�̑ш敝�͑���̈�r�����ǂ��Ă���B���̂��ߍ����ȃf�[�^�]�����\�ɂȂ������A�]����TCP�ł͍L�ш�l�b�g���[�N�ɂ����Ė��������X���[�v�b�g�������Ȃ��Ƃ������_�����サ�Ă����B����͓`�d�x���ƓK�łȂ��E�B���h�E�T�C�Y�̉e�����傫���ƌ�����B�E�B���h�E�T�C�Y���������ƁA��x�ɑ����p�P�b�g�̑��M�ʂ����Ȃ��Ȃ�B���̂��߁A1�Z�b�V�������ł̑��M�͑�������B�����āA1�Z�b�V�����̓]���̍��v���Ԃ́w�`�d�x�����ԁx�{�w�f�[�^�]�����ԁx�~�w���M�x������B�P��̑��M���ƂɁw�`�d�x�����ԁx�������邽�߁A�ʐM���ԓ��̓`�d�x���̍��v�͑��M�~�`�d�x���ƂȂ�B����āA�P��̑��M���Ƃɂ�����`�d�x�������M���|���邱�ƂɂȂ�A�P�Z�b�V�����ɂ����鎞�Ԃ̒��̓`�d�x�����Ԃ̊����������Ȃ��Ă��܂��B���̉������@�Ƃ��āATCP�̍ő�E�B���h�E�T�C�Y��64KB�ȏ�Ɋg�����A���M�����炷���Ƃɂ��A�`�d�x�����Ԃ̍��v�����炷�Ƃ������Ƃ�ꂽ�B����̓X�P�[���I�v�V�������Ă����̂ŁA�ő�E�B���h�E�T�C�Y��1GB�܂Ŋg���ł��邽�ߓ��ʂ͂��̃I�v�V�����ōL�ш�l�b�g���[�N�ɑΉ��͂ł���悤�ɂȂ����B���̗�������ăE�B���h�E�T�C�Y�̐���͑ш�̗L���I�ȗ��p�ɐ[�����ѕt���Ă���Ƃ�����B

���̏͂ł�TCP���t�s����ɂ��ďq�ׂ�B

TCP�́AOSI�Q�ƃ��f���ɂ��Ă͂߂�ƁA�g�����X�|�[�g�w�̃v���g�R���ł���B�C���^�[�l�b�g�𗘗p�����ł�IP�Ɏ����ŏd�v�ȃv���g�R���ł���BTCP�ɂ�UDP�iUser Datagram Protocol�j�Ƃ͈Ⴂ�t�s����̋@�\����������Ă���B����͕����̃o�[�W����������TCP���t�s����Ƀt�H�[�J�X����B�t�s��������ɂ́A�傫�������ć@���X�x�[�X�����A�A�x���x�[�X�����̓��ނ�����A�ߔN�͇B�n�C�u���b�g�����i�@�ƇA�̕����^�j���o�ꂵ���ڂ���Ă���B

Tahoe��1988�N���납�痘�p����Ă���TCP�ł���B�����Ƃ��Ă̓X���[�X�^�[�g�i�K���t�s���i�K�ɕ�������E�B���h�E�T�C�Y����ƁAFast Retransmit�A���S���Y���Ƃ����������đ��A���S���Y�����̗p�����_�ɂ���B�t�s����̗����}�P���t�s�E�B���h�E�T�C�Y�̕ω��̃O���t��p���Đ�������B�܂��A臒l�i�ȉ�ssthresh)���߂邽�߂ɁA�t�s���N����܂Ńp�P�b�g���M�������Ȃ��A�t�s���N���������_���t�s�E�B���h�E�T�C�Y�̂Q���̂P(cwnd/2)��ssthresh�ƒ�߂�B����ȍ~�́Assthresh�܂ŃX���[�X�^�[�g�i�K�ŁAACK����邲�ƂɂP���ɃE�B���h�E�T�C�Y���w���I�ɑ��������āAssthresh�ȏ�ɂȂ���t�s���i�K�Ɉڍs���t�s�E�B���h�E�T�C�Y���̂P�i1/cwnd�j�����`�I���t�s�E�B���h�E�T�C�Y��������B�����t�s���i�K�ōĂ��t�s���N�������ꍇ���t�s�E�B���h�E�T�C�Y���ŏ��̂P�ɂ܂ŗ��Ƃ��ăX���[�X�^�[�g�i�K���炨�Ȃ��H�����J��Ԃ��悤�ɂȂ��Ă���B

Fast Retransmit�A���S���Y���̓��X�g�����p�P�b�g���đ��^�C�}�̃^�C���A�E�g��҂����ɁA�v���Ƀp�P�b�g���đ�����A���S���Y���ł���B��M���m�[�h����đ��v������m�F�����p�P�b�g�i�`�b�j�p�P�b�g�j���d�����ĂR���������ꍇ�̓f�[�^�p�P�b�g���j�����ꂽ�\���������Ɣ��f���đ��^�C�}�̃^�C���A�E�g��҂����ɁA���Y�p�P�b�g��v���ɓ]������B���̌�̓X���[�X�^�[�g�i�K�Ɉڍs����B

Reno��1990�N�ɓo�ꂵ���o�[�W�����ł���A����͑O����Tahoe���t�s����A���S���Y���ɉ��ǂ�������Fast Recovery�A���S���Y�����̗p�������̂ł���BTahoe�̏ꍇ�A�t�s���N�����ꍇ���t�s�E�B���h�E�T�C�Y���P�܂ŗ��Ƃ��āA�X���[�X�^�[�g�i�K����J�n���邽�߁A���x�𗎂Ƃ������Ă��܂��Ƃ��������_���������B�������AFast Recovery�A���S���Y���́A�t�s�����������Ƃ����t�s�E�B���h�E�T�C�Y�̂Q���̂P�icwnd/2�j�̒l��ssthresh�ɐݒ肵�A����t�s�����������ꍇ���t�s�E�B���h�E�T�C�Y���P�܂ʼn�������ssthresh�����t�s���i�K�ɓ���A���S���Y���ɂȂ��Ă���B����ɂ��ߏ���t�s�E�B���h�E�T�C�Y�̌�����������邽�ߍ����ȓ]�����\�ƂȂ����B

New Reno��1996�N�ɓo�ꂵ���o�[�W�����ŁA�O����Reno��Fast Recovery�A���S���Y���̃p�P�b�g���X�g���̍����ꍇ�ɑ��ẴA���S���Y���̕s����C���������̂ł���BReno��Fast Retransmit�A���S���Y���ł́A�P�̃p�P�b�g���j�����ꂽ�Ƃ��ɂł��đ��M���[�h�ɓ����Ă��܂����߁A���̂Ƃ��V�����p�P�b�g�̑��M����~�����B���̂悤�ȃp�P�b�g�̔j�������W���Ĕ�������ƁA�X���[�v�b�g���ɒ[�ɗ����Ă��܂��Ƃ������s����������BNewReno�ł́A���̕s����������A�P��̍đ��M���[�h�ŕ����̃p�P�b�g���đ��M����悤�ɉ��ǂ��ꂽ�B

Vegas�͂���܂ł�TCP�t�s�A���S���Y���ƈႢ�A�ڍׂȒʐM�o�H�̏�Ԃ𐄑�����@�\�����ڂ���āA���G�̋�ɉ������]�����x�̒��߂��\�ɂȂ��Ă���B�ʐM�o�H�̏�Ԃ̔c���ɂ̓��E���h�E�g���b�v�E�^�C���i�ȉ�RTT�j�𗘗p����BVegas���t�s����A���S���Y���̓f�[�^�]�����Ȃ���RTT���v�����AActual Througput��Expected Througput�̂Q�̃X���[�v�b�g���r����BActual Througput�͎��ۂ̓]�������ۂɂ��������v���l�ł���AExpected Througput�͓]�����ʂ��琄���l�ł���B�����̒l���r���A�wActual��Expected�x�ɂȂ����ꍇ�̓l�b�g���[�N������ł����Ƃ݂Ȃ����t�s�E�B���h�E�T�C�Y���P���炵�]�����x�𗎂Ƃ��B�l���wActual��Expected�x�ɂȂ����ꍇ�̓l�b�g���[�N���Ă����Ƃ݂Ȃ����t�s�E�B���h�E�T�C�Y���P���₵�ē]�����x��������B�����āA�wActual��Expected�x�̏ꍇ�̓l�b�g���[�N�����肵�Ă���Ƃ݂Ȃ��ē]�����x���ێ�����B

�n�C�u���b�g������CTCP��Windows�nOS��Vegas�Ɉڍs���邽�߂̑O�����Ƃ��ēo�ꂵ���B�o�ꂵ���o�܂Ƃ���Reno��Vegas�̋�����肪��������BVegas��Reno�ANew Reno�ȂNj������邱�Ƃɂ��A�K�ȃE�B���h�E�T�C�Y�̒������s�����Ƃ��ł����ARTT�̑����ƃE�B���h�E�T�C�Y�̒ቺ�ɂ��X���[�v�b�g�̒ቺ���w�E����Ă���B���̂悤�ɁAVegas��Reno�ANew Reno�ɑш��D���Ă��܂����߁A�����Ȑ��䂪�s���Ȃ��Ƃ��������_��L���Ă��邪�ACTCP�ł́A���̌��_��₤���߂Ƀl�b�g���[�N�̊��ʂ�Vegas��New Reno���t�s������ւ���@�\��L���Ă��̂ŋ���������邱�Ƃ��\�ɂȂ��Ă���B ���Ȃ݂ɁACTCP��2006�N�ɔ������ꂽWindows Vista�ɏ��߂ē��ڂ��ꂽ���AVegas���[�h�ŃE�B���h�E�T�C�Y���傫���Ȃ�Ȃ��Ƃ����o�O������������ɂȂ����B���̂��߁A����I�ȍ̗p�ł������͂���CTCP�̃f�r���[��Microsoft�̎��Ԃɂ���ėǂ��C���[�W���c��Ȃ������̂�����Șb�ł���B

���̏͂ł͎����Ŏg�p����l�b�g���[�N�V�~�����[�^�Ǝ������@�ɂ��ĉ������B

NS2(Network Simulator Version.2)�͕č�DARPA�̌����v���W�F�N�gVINT(Visual InterNet Testbed�j�̌������ʂ̈�ŁA�C���^�[�l�b�g�̐V�����Z�p�̊J���𑣐i���邽�߂ɊJ�����ꂽ���̂ł���BNS2��OPNET�Ȃǂ̑��̃l�b�g���[�N�V�~�����[�^�Ƃ͈قȂ芮�S�������p�u���b�N�h���C���A�I�[�v���\�[�X�̃\�t�g�E�F�A�ł���B���̂���NS�̓l�b�g���[�N�����̂��߂̊�{�c�[���Ƃ��Ă̒n�ʂ��m�����Ă���B

�@���̂��߁A�R�}���h���C���A�e�L�X�g�x�[�X�Ƃ������悤�ȕ��G���ώG�ȃ��[�U�[�C���^�t�F�[�X�ł�������A�K�w���f���̃V�~�����[�g���ł��Ȃ�������ƁA�L���̃\�t�g�E�F�A�Ɣ�ׂĂ��܂��Ɗ������_�����邪�A�l�b�g���[�N�w�A�g�����X�|�[�g�w�A�����l�b�g���[�N�̃V�~�����[�V��������r�I�ȒP�ɂł���悤�ɂȂ��Ă��邽�߁A����@�ւ⌤���@�ւő����g���Ă���B

NS2�͑傫�������ăl�b�g���[�N�V�~�����[�^��ns�ƃr�W���A���C�U��nam�̂Q�_����\������Ans�ŃV�~�����[�g�����e�L�X�g�x�[�X�̃V�~�����[�V�������ʂ�nam�Ńl�b�g���[�N�}��p�P�b�g�̗�������o�����邱�Ƃ��\�ɂȂ��Ă���Bns�ŃV�~�����[�V�������s���ɂ́A�R���|�[�l���g��C++�ŋL�q���A�l�b�g���[�N�g�|���W��m�[�h�̒�`��Otcl����ŋL�q����X�^�C���ƂȂ��Ă���B����͎��s���x�̑���C++�ƁA�P���ȋL�q������Otcl�̃����b�g��g�ݍ��킹�č����Ȏ��s�Ǝ�y�ȃl�b�g���[�N��`���������邽�߂ł���B

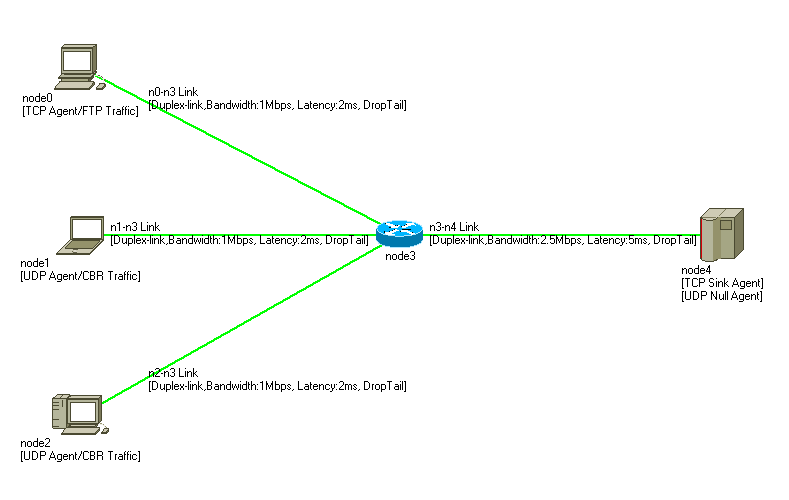

����̎����̃V�i���I�͈ȉ��̐}�R�A�\�P�A�\�Q��p���ĉ������B

�V�~�����[�V�����͐}�T�Ŏ����悤�ɂT�̃m�[�h�ƂS�̃����N����\�������B�m�[�h�ƃ����N�͈ȉ��̕\�P�̂悤�ɒ�`����B

| �m�[�h�A�����N�� | �m�[�h�A�����N��` |

|---|---|

| n0�F���M�m�[�h | n0-n4�Ԃ̃R�l�N�V�������m���A552KB��TCP�p�P�b�g�𑗐M |

| n1�F���M�m�[�h | n1-n4�Ԃ̃R�l�N�V�������m���A1Mbps�̌Œ背�[�g�iCBR)��1000KB��UDP�p�P�b�g�𑗐M |

| n2�F���M�m�[�h | n2-n4�Ԃ̃R�l�N�V�������m���A 1Mbps�̌Œ背�[�g�iCBR)��1000KB��UDP�p�P�b�g�𑗐M |

| n3�F���p�m�[�h | ���p�i���[�^�j�A�L���[���~�b�g�F20 |

| n4�F��M�m�[�h | n0��TCP Sink�G�[�W�F���g�An1�An2�����CBR�p�P�b�g�̎�M |

| n0-n3�����N | n0-n3�ԁA�S��d�A1Mbps�A�`�d�x��2ms�A�h���b�v�e�[���^�̃����N���` |

| n1-n3�����N | n1-n3�ԁA�S��d�A1Mbps�A�`�d�x��2ms�A�h���b�v�e�[���^�̃����N���` |

| n2-n3�����N | n2-n3�ԁA�S��d�A1Mbps�A�`�d�x��2ms�A�h���b�v�e�[���^�̃����N���` |

| n3-n4�����N | n3-n4�ԁA�S��d�A2.5Mbps�A�`�d�x��5ms�A�h���b�v�e�[���^�̃����N���` |

�V�~�����[�V�����͈ȉ��̕\�Q�̏����Ŏ��s�����B

| ����(sec) | �C�x���g |

|---|---|

| 0.00 | �V�~�����[�V�����J�n |

| 1.00 | n0��TCP�ʐM���J�n |

| 4.01 | n1��UDP���M�J�n |

| 5.01 | n2��UDP���M�J�n |

| 10.00 | n0,n1,n2���M��~ |

| 10.10 | �V�~�����[�V�����I�� |

����̎����͈Ӑ}�I���t�s�������邽�߂ɁAnode3���獶���̍��v�̑ш悪3Mbps�A�E���̑ш��2.5Mbps�Ƃ����B�܂��Anode0��TCP�̃G�[�W�F���g�������Bnode1�Anode2�Anode3-node4�Ԃ̃����N�ɕ��ׂ������邽�߂�UDP�G�[�W�F���g���������A1Mbps�̌Œ�r�b�g���[�g�iCBR)�̒ʐM���s���B���ԂƂ��Ă͂P�D�O�O�b�̒ʐM�J�n����S�D�O�O�b�܂ł̊Ԃ�TCP�̒ʐM��node3-node4�Ԃ̒ʐM�őш���L���傫���t�s���N���炸�ɒʐM���s���A�S�D�O�P�b�ɂ�node1��UDP�p�P�b�g�𑗐M���A�T�D�O�P�b�ɂ�node2��UDP�p�P�b�g�̑��M���J�n����B���̂Ƃ���node0���瑗�M���ꂽTCP�̃p�P�b�g���t�s�ɂ��j�������Ɖ��肵�V�~�����[�V���������s����B

��L�̃V�i���I��NS2�ŃV�~�����[�V�������s�����߂ɁA�ȉ��̃v���O�������L�q�����B

set ns [new Simulator] ;# �I�u�W�F�N�g�̐���

# �t���[�ɐF���`�inam�ŕ\�����Ɏg�p�j

$ns color 0 blue

$ns color 1 red

$ns color 2 yellow

# �m�[�h�̒�`

set n0 [$ns node]

set n1 [$ns node]

set n2 [$ns node]

set n3 [$ns node]

set n4 [$ns node]

# �o�͐�̒�`

set tf [open tahoe.tr w] ;# NAM�p�g���[�X�t�@�C�����������ݑ����ŊJ��

$ns trace-all $tf

set winfile [open cwnd_tahoe.tr w] ;# �t�s�E�B���h�E�̃g���[�X�t�@�C�����������ݑ����ŊJ��

set nf [open tahoe.nam w] ;# NAM�t�@�C�����������ݑ����ŊJ��

$ns namtrace-all $nf

# �����N�̒�`

$ns duplex-link $n0 $n3 1Mb 2ms DropTail ;# �S��d,node0-node1��,1Mbps,�x��2ms,DropTali�^�̃����N ���P

$ns duplex-link $n1 $n3 1Mb 2ms DropTail ���P

$ns duplex-link $n2 $n3 1Mb 2ms DropTail ���P

$ns duplex-link $n4 $n3 2.5Mb 5ms DropTail ���P

# n3��queue�̒�`

$ns queue-limit $n3 $n4 20 ;# �����Nn3-n4�Ԃ̍ő�L���[�T�C�Y���`����B

# nam��ł̕\���ʒu�̒�`

$ns duplex-link-op $n3 $n0 orient left-up

$ns duplex-link-op $n3 $n1 orient left

$ns duplex-link-op $n3 $n2 orient left-down

$ns duplex-link-op $n4 $n3 orient left

# n4-n3�Ԃ̃L���[�����j�^�����O����

$ns duplex-link-op $n4 $n3 queuePos 0.5

# TCP0�̃R�l�N�V�����̒�`

set tcp0 [new Agent/TCP] ���Q

$ns attach-agent $n0 $tcp0 ;# n0��TCP�G�[�W�F���g������

set sink0 [new Agent/TCPSink]

$ns attach-agent $n4 $sink0 ;# n4��TCPSink�G�[�W�F���g������

$ns connect $tcp0 $sink0 ;# n0-n4�Ԃ̃s�A�ڑ����m��

$tcp0 set fid_ 0 ;# tcp0�̃t���[ID��0�ɒ�`

$tcp0 set window_ 8000 ;# �ő�E�B���h�E�T�C�Y

$tcp0 set packetSize_ 552 ;# �p�P�b�g�T�C�Y��552KB�ɒ�`

$tcp0 trace cwnd_ ;# �t�s�E�B���h�E���g���[�X

# $tcp0 attach $winfile ;# �t�s�E�B���h�E�̃g���[�X���ʂ�winfile�ɏo��

set ftp0 [new Application/FTP] ;# FTP�g���t�B�b�N�̐���

$ftp0 attach-agent $tcp0 ;# FTP�g���t�B�b�N��tcp0(node0)�Ɏ���

# UDP1�̃R�l�N�V�����̒�`

set udp1 [new Agent/UDP] ;# UDP�G�[�W�F���g�̒�` �@�@�@�@�@���R

$ns attach-agent $n1 $udp1 ;# node1��UDP�G�[�W�F���g�̎���

set null [new Agent/Null] ;# UDP Null�G�[�W�F���g�̒�`

$ns attach-agent $n4 $null ;# node4��UDP Null�G�[�W�F���g�̎���

$ns connect $udp1 $null ;# UDP�G�[�W�F���g��Null�G�[�W�F���g�̐ڑ�

$udp1 set fid_ 1 ;# �t���[ID��1�ɒ�`

set cbr1 [new Application/Traffic/CBR] ;# CBR�g���t�B�b�N�̐���

$cbr1 attach-agent $udp1 ;# UDP�G�[�W�F���g��CBR�g���t�B�b�N�W�F�l���[�^������

$cbr1 set type_ CBR ;# cbr1����������g���t�B�b�N��CBR�i�Œ背�[�g�j�ɐݒ�

$cbr1 set packet_size_ 1000 ;# �p�P�b�g�T�C�Y��1000KB�ɐݒ�

$cbr1 set rate_ 1mb ;# 1Mb/s�̃��[�g�Ńg���t�B�b�N��

$cbr1 set random_ false ;#

# UDP1�̃R�l�N�V�����̒�`

set udp2 [new Agent/UDP] ���R

$ns attach-agent $n2 $udp2

set null [new Agent/Null]

$ns attach-agent $n4 $null

$ns connect $udp2 $null

$udp2 set fid_ 2

set cbr2 [new Application/Traffic/CBR]

$cbr2 attach-agent $udp2

$cbr2 set type_ CBR

$cbr2 set packet_size_ 1000

$cbr2 set rate_ 1mb

$cbr2 set random_ false

# �X�^�[�g����

$ns at 1.0 "$ftp0 start" ���S

$ns at 4.01 "$cbr1 start" ���S

$ns at 5.01 "$cbr2 start" ���S

# �I������

$ns at 10.0 "$ftp0 stop" ���S

$ns at 10.0 "$cbr1 stop" ���S

$ns at 10.0 "$cbr2 stop" ���S

#�t�s�E�B���h�E�̕ϓ��L�^

proc plotWindow {tcpSource file} {

global ns

set time 0.1

set now [$ns now]

set cwnd [$tcpSource set cwnd_];

puts $file "$now $cwnd"

$ns at [expr $now+$time] "plotWindow $tcpSource $file"

}

$ns at 0.1 "plotWindow $tcp0 $winfile"

$ns at 10.1 "finish"

# �I���㏈���̃v���V�[�W��

proc finish {} {

global ns tf nf winfile

$ns flush-trace

close $tf ;# �g���[�X�t�@�C�������

close $nf ;# nam�p�g���[�X�t�@�C�������

close $winfile ;# �t�s�E�B���h�E�g���[�X�t�@�C�������

# nam�����s����

puts "running nam..."

exec nam tahoe.nam &

exit 0

}

$ns run

��L�̃v���O�����̗v�_�̉�����s���B

���P�ł͊e�m�[�h�Ԃ̃����N�̒�`�����Ă���B�����N�̒�`�́A�n�_�m�[�h�ԍ��A�I�_�m�[�h�ԍ��A�ш敝�A�`�d�x���A�h���b�v�`�����`���邱�Ƃ��ł���A�p�����[�^�͕\�P�Ŗ��L���Ă���悤�ɁAnode0-node3�ԁAnode1-node3�ԁAnode2-node3�Ԃ̃����N�͑S��d�A1Mbps�A�x��2ms�A�h���b�v�e�[���^�̃����N���`�����Bnode3-node4�Ԃ̃����N�͑S��d�A2.5Mbps�A�x��5ms�A�h���b�v�e�[���^�̃����N���`�����B

���Q�ł�node0�̃G�[�W�F���g�̒�`���s���Ă���B����A��ɋ������v���O�����́ATahoe�ł̒ʐM���s���ꍇ�̂��̂ł��邽�߁AReno�ANewReno�AVegas�ŒʐM���s���ꍇ�� ���Q �̍s���ȉ��̂悤�ɏ���������B

set tcp0 [new Agent/TCP/Reno]

set tcp0 [new Agent/TCP/Newreno]

�@set tcp0 [new Agent/TCP/Vegas] ���R�ł́A�l�b�g���[�N�ɕ��ׂ������邽�߂�UPD/CBR�g���t�B�b�N���`�����B1Mbps�̌Œ背�[�g�Ńg���t�B�b�N�����A1000KB��UDP�p�P�b�g�𑗐M����B

���S�ł́A�e�m�[�h�̒ʐM�J�n���ԂƒʐM�I�����Ԃ̒�`���s���Ă���B����͕\�Q�̃^�C���e�[�u���ɏ]���āATCP��FTP�t���[���O�D�O�P�b�AUDP��CBR�t���[���S�D�O�P�b�A�T�D�O�P�b�ɊJ�n���āA���ׂĂ̒ʐM���P�O�D�O�P�b�ɏI��������B

�e�o�[�W������TCP�ɂ��V�~�����[�V�������ʂ��ȉ��̓��v�f�[�^�ɂĕ���B

�ȏ�̐}�U�A�}�V�̃O���t��p����Tahoe�̎������������B�}�U�̃X���[�v�b�g�̕ω��i�ȉ�Throughput�j����node1��UDP/CBR�̒ʐM���n�܂�4.01�b�O��́A�X���[�X�^�[�g�i�K�ȊO�́A�قڃ����N���x���g�����Ă��邱�Ƃ��m�F�ł��邪�A5.01�b��node2��UDP/CBR�̒ʐM���n�܂�������t�s���������A�t�s�E�B���h�E�T�C�Y�i�ȉ�cwnd�j�AThroughput�̒ቺ���m�F�ł���B�}�V�̃V�[�P���X�i���o�[�̗ݐϕω��i�ȉ�sqno�j��5.01�b�܂ł̓X���[�X�^�[�g�i�K�ȊO�Acwnd�̒ቺ�͌���ꂸ�A5.01�b�ȍ~��node2��UDP/CBR�ʐM���J�n���cwnd�̑傫�Ȓቺ���W�����AThroughput�����ɉ��������Ƃ��m�F�ł���B

�ȏ�̐}�W�A�}�X�̃O���t��p����Reno�̎������������B�������Tahoe�Ɠ��l�ɐ}�W��Throughput����node1��UDP/CBR�̒ʐM���n�܂�4.01�b�O��́A�X���[�X�^�[�g�i�K�ȊO�A�قڃ����N���x���g�����Ă��邱�Ƃ��m�F�ł��邪�A5.01�b��node2��UDP/CBR�̒ʐM���n�܂�������t�s���������Acwnd�AThrougput�̒ቺ���m�F�ł���B�}�X��sqno��5.01�b�܂ł̓X���[�X�^�[�g�i�K�ȊO�Acwnd�̒ቺ�͌���ꂸ�A5.01�b�ȍ~��node2��UDP/CBR�ʐM���J�n���cwnd�̑傫�Ȓቺ���X�����AThrougput�����ɉ��������Ƃ��m�F�ł���B

�ȏ�̐}�P�O�A�}�P�P�̃O���t��p����New Reno�̎������������B�������Tahoe�AReno�Ɠ��l�ɐ}�P�O��Throughput����node1��UDP/CBR�̒ʐM���n�܂�4.01�b�O��́A�X���[�X�^�[�g�i�K�ȊO�A�قڃ����N���x���g�����Ă��邱�Ƃ��m�F�ł��邪�A5.01�b��node2��UDP/CBR�̒ʐM���n�܂�������t�s���������Acwnd�AThrougput�̒ቺ���m�F�ł���B�}�P�P��sqno��5.01�b�܂ł̓X���[�X�^�[�g�i�K�ȊO�Acwnd�̒ቺ�͌���ꂸ�A5.01�b�ȍ~��node2��UDP/CBR�ʐM���J�n���cwnd�̑傫�Ȓቺ���X�����AThrougput�����ɉ��������Ƃ��m�F�ł���B

�ȏ�̐}�P�Q�A�}�P�R�̃O���t��p����Vegas�̎������������B������͍��܂ł̎������ʂƂ͈قȂ�A�X���[�X�^�[�g�i�K�ň�x�A�E�B���h�E�T�C�Y�̒ቺ�����������ȊO��5.01�b�܂�cwnd�AThroughput���ɂقڈ��l��ۂ����肵���ʐM���s���A5.01�b�ȍ~�͑傫��cwnd�AThroughput�Ƃ��ɉ��������A�قڈ��l��ۂ������Ƃ��m�F�ł���B�}�P�R��sqno��5.01�b�ȍ~�����ɑ����ʂ͓݉����邪�A��ɒ����I�ɑ������Ă��邱�Ƃ��m�F�ł���B

�O���̎������ʂ���e�o�[�W�������t�s����ɂ͓��������邱�Ƃ�������B�f�[�^���ȉ��̕\�R�ɂ܂Ƃ߂ĉ������B

| Tahoe | Reno | New Reno | Vegas | |

|---|---|---|---|---|

| �h���b�v���ꂽ�p�P�b�g(Packet) | 28 | 29 | 30 | 0 |

| ���M���ꂽ�p�P�b�g(Packet) | 1418 | 1419 | 1462 | 1475 |

| ���σX���[�v�b�g(Kbps) | 649.64 | 637.38 | 659.95 | 723.24 |

���j�I�ɌÂ����̂��珇�ԂɃV�~�����[�V�������s���A���ʂ��܂Ƃ߂�ƕ\�R�̂悤�ɂȂ����B���̌��ʁATahoe�Ƃ�������ǂ���Reno�̑����M�p�P�b�g���̍��́A�h���b�v�p�P�b�g���A���M�p�P�b�g�����ɍ��͂P�p�P�b�g�ŁA���σX���[�v�b�g�Ɏ����Ă�Reno����錋�ʂƂȂ����B����͑�Q�͂ł��q�ׂĂ���Reno��Fast Retransmit�A���S���Y���̕s��ɂ����̂ŁAReno�͑��M�����p�P�b�g���͑������̂́A�}�X�̕��ה�����̃V�[�P���X�i���o�[�̕ϓ������ĕ����邪�A�p�P�b�g���X���N���������̍đ����[�h�ɂ���ăX���[�v�b�g���ቺ���Ă���ƌ�����B�܂��A���nj^��New Reno��Fast Retransmit�A���S���Y���̕s�����������Ă��邽�߁A���ה�����̃V�[�P���X�i���o�[�̕ϓ����X���[�Y�ŁA���M���ꂽ�p�P�b�g���A���σX���[�v�b�g���Ɍ��サ�Ă���BVegas�Ɏ����Ă͑��M�p�P�b�g���A�h���b�v�p�P�b�g�A���σX���[�v�b�g���ł��ǂ����ʂ��̂������B�}�P�Q�A�}�P�R�𑼂̃o�[�W�����Ɣ�ׂ��Vegas���t�s�E�B���h�E�A���σX���[�v�b�g�A�V�[�P���X�i���o�[�̗ݐϕω��̂R�Ƃ������I�ȕω��ł��邱�Ƃ�������B����́A����ꂽ�ш��L���I�Ɏg�p���Ă��錋�ʂƌ�����B

����́ANS2���g���Ď�v��TCP���t�s����������ώ@�����BTCP�̑b��z����Tahoe�ATahoe�����ǂ���Reno�ANewReno�A�x���x�[�X�����Ƃ����T�O���m������Vegas�B����̎����ł͍ł��ш��L���I�Ɏg�����t�s���������Vegas�Ƃ������ʂ��o���BVegas�͒a�����琔�N�o�߂��Ă��邪�A����ł͂��܂蕁�y���Ă��Ȃ��B���̗��R�Ƃ��ċ������Ă���̂��A����Windows�n��OS�Ŏ嗬��Reno�ANewReno�Ƌ����������ł́AVegas��RTT�����A�t�s�E�B���h�E�T�C�Y�̌����ɂ��A�X���[�v�b�g�̒ቺ���������邱�Ƃ��w�E����Ă��邱�Ƃ��v���ƍl������B���̂悤���t�s��������̈Ⴂ�ɂ��s�������N��悤�ł���A�����I���t�s��������ł����Ă����y�ɂ܂ł͎���Ȃ��Ƃ������Ƃ�Vegas�̗�������Č����邾�낤�B�������AWindows Vista�ȍ~��CTCP�i����Ɏ������ꂽVegas�j��W���T�|�[�g���鎖�ɂȂ�Ǝv���邽�߁A�i�K�I��Vegas���W�����t�s��������ƂȂ��Ă����ƍl������B����AVegas�ւ̐�ւ��̌������Ƃ��ăn�C�u���b�g������CTCP���傫�Ȗ�ڂ��ʂ����ƌ�����B